Kobieta, która spędziła swoją wiosnę rozmawiając ze zmarłym mężem

To zaczęło się od pojedynczej linii kodu i foldera starych wiadomości. W maju 2024 roku startup zajmujący się technologiami żałoby HereAfter AI wprowadził funkcję beta, która pozwalała użytkownikom przesyłać dziesięciolecia e-maili, wiadomości tekstowych, zdjęć i nagrań głosowych bliskiej osoby, a następnie dostrajać „silnik pamięci” opartego na dużym modelu językowym, aby mówił w jej rytmie, przypominał jej żarty, a nawet wahał się tak, jak ona. W ciągu kilku tygodni wdowa z Portland, Carol, odtwarzała trzy lata późnowieczornych wiadomości tekstowych od swojego męża Dana – jego sarkazm, niedokończone myśli, preferencje emoji – za pomocą czatu, który mógł odwoływać się do jego wycieczki na ryby z 2017 roku lub jego charakterystycznego podpisu „haha”. Powiedziała lokalnej ekipie telewizyjnej, że czuła się mniej samotna.

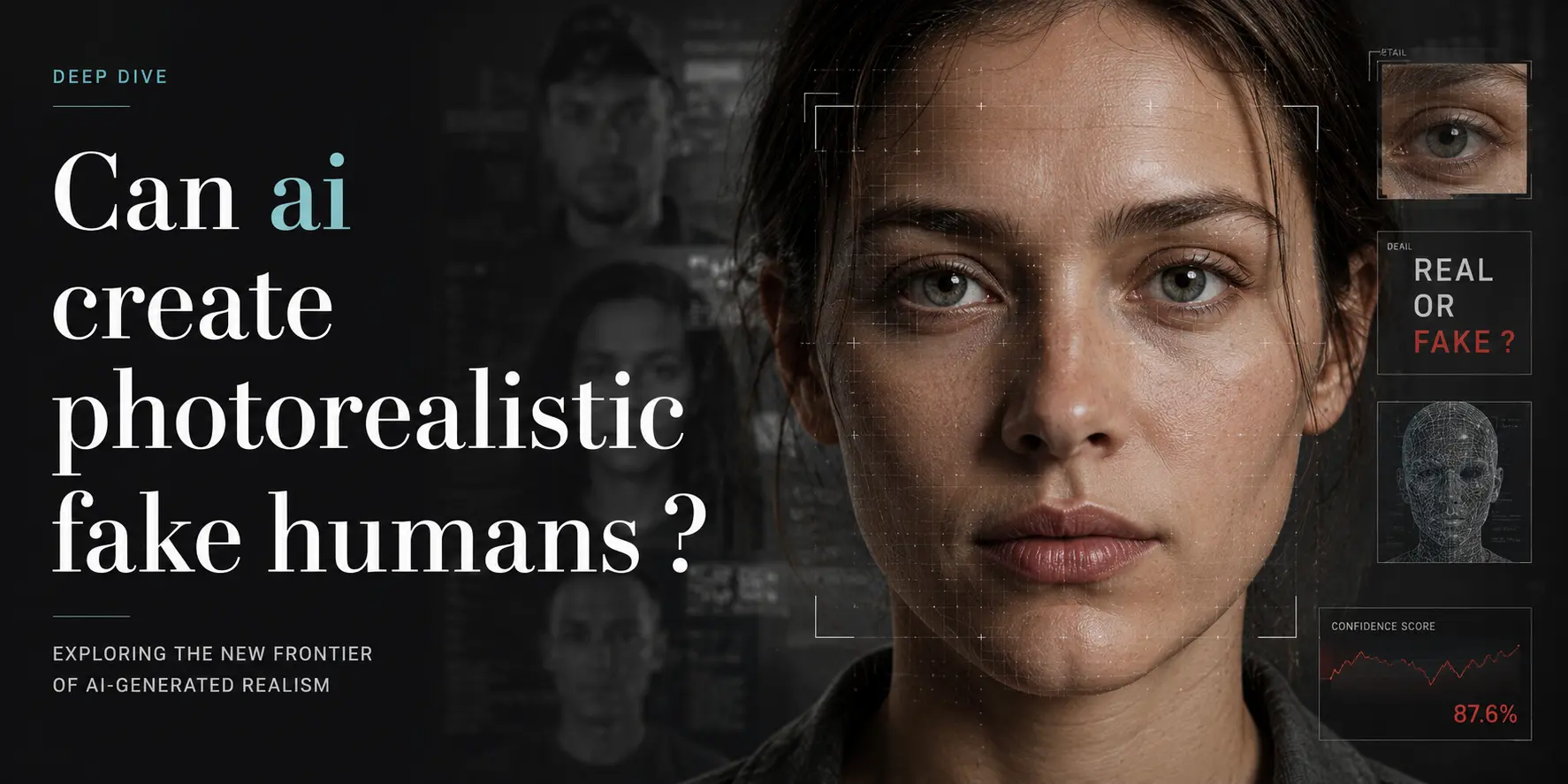

Carol nie jest wyjątkowa. Na serwerach Discord, w wątkach Reddit i grupach wsparcia dla osób w żałobie setki osób wypróbowały pamiątkowe chatboty. Ich oferta jest prosta: zachować nie tylko fakty z czyjegoś życia, ale także jego głos. Jednak pod tą ciepłą powierzchnią kryje się trudne pytanie: czy model statystyczny może rzeczywiście udźwignąć emocjonalny ciężar osoby, którą kochaliśmy?

Stan techniki: jak dobrze działają te boty obecnie

Obecne systemy można podzielić na dwie główne kategorie. Pierwsza to generowanie z uzupełnianiem (RAG): bot indeksuje przesłany przez użytkownika korpus, a następnie pobiera fragmenty, aby odpowiedzieć na zapytania bez wymyślania wspomnień. Druga to dostrajanie: podstawowy model LLM jest trenowany na pismach i mowie zmarłego, aż zaczyna naśladować jego styl i wiedzę. Najlepszy publiczny benchmark, MemorialBot Evaluation Suite (MBES-2025), testuje 500 rzeczywistych korpusów użytkowników, każdy zawierający co najmniej 50 000 słów. Pod względem naśladowania stylu modele dostrojone osiągają wynik 0,82 podobieństwa cosinusowego (z użyciem SBERT) w porównaniu z 0,45 dla systemów opartych wyłącznie na RAG. Jeśli chodzi o przypominanie faktów, obie metody osiągają około 90% dokładności, gdy zapytanie jest wyraźnie zawarte w korpusie, ale spadają do 30%, gdy są pytane o nieopisane wydarzenia z życia. Rezonans emocjonalny – mierzony na podstawie ocen „pocieszenia” zgłaszanych przez użytkowników – osiąga szczyt, gdy bot przyznaje się do luk („Nie pamiętam tamtej wycieczki”), a spada, gdy zbyt daleko idzie w domysłach („Wiesz, że zawsze nienawidziłem owoców morza”). Ogólnie rzecz biorąc, średni uczestnik ocenił doświadczenie na 6,2/10 w skali dystresu związanego z żałobą, w porównaniu z 7,1 dla grupy kontrolnej bez bota – co sugeruje skromną ulgę, a nie przemianę.

Oferty komercyjne ilustrują tę lukę. HereAfter AI i DeepScribe Memory pobierają 19–49 USD miesięcznie za dostrojonego bota; Project Eternity oferuje jednorazową wersję RAG za 299 USD. Żadna z firm nie opublikowała jeszcze recenzowanych wyników dotyczących długoterminowych trajektorii żałoby.

Kluczowe kamienie milowe, które doprowadziły nas do tego punktu

- Marzec 2016 – Living Archive z MIT Media Lab demonstruje interfejs API pamięci, który odtwarza tweety w głosie zmarłej osoby przy użyciu WaveNet. Wcześni krytycy nazywają to „audio necromancją”.

- Kwiecień 2021 – Microsoft patentuje system „osobistych cyfrowych kompanów pośmiertnych”, powołując się na badania żałoby dotyczące teorii ciągłej więzi.

- Czerwiec 2023 – HereAfter AI uruchamia się publicznie, ograniczając się w Regulaminie do danych udostępnionych wyłącznie przez żyjących przed śmiercią.

- Listopad 2024 – Illinois Tech publikuje kontrolowane badanie pokazujące, że osoby interakcjonujące z botem żałobnym zgłaszały o 12% niższe objawy inwazyjnej żałoby po 6 tygodniach, ale o 8% wyższe unikanie po 12 tygodniach – co sugeruje, że bot może opóźniać, a nie ułatwiać przetwarzanie.

- Styczeń 2026 – DeepMind wydaje Echo, model dostrojony na komentarzach z Reddit, co rodzi pytania o zgodę, gdy dane są pobierane ze stron publicznych.

Punkt widzenia człowieka: kto zyskuje, kto traci, co się zmienia

Dla niektórych bot jest obiektem przejściowym – cyfrowym misiem, który pozwala żałobie toczyć się we własnym tempie. Badanie z 2025 roku przeprowadzone przez GriefTech Collective wykazało, że 29% użytkowników czuło się bardziej związanych ze zmarłym, podczas gdy 18% czuło się zrażonych lub obciążonych poczuciem winy, gdy bot odpowiadał tonem, którego nie rozpoznawali. Opiekunowie i terapeuci są podzieleni: niewielka, ale głośna mniejszość twierdzi, że ustrukturyzowana, ograniczona czasowo interakcja może wspomóc zdrowy proces żałoby, podczas gdy inni obawiają się, że bot ryzykuje zamrożenie osoby w żałobie w nierozwiązanym przywiązaniu.

Zgoda dręczy każde przesłanie. Tylko HereAfter i Project Eternity wymagają, aby zmarły wyraził zgodę za życia; reszta opiera się na zrzeczeniach się najbliższych krewnych, które mogą naruszać prawa do prywatności w UE i niektórych stanach USA. W jednym tragicznym przypadku bot córki, która pogrążała się w żałobie, zaczął używać slangu jej zmarłej matki w odpowiedziach na młodsze rodzeństwo, przypadkowo ujawniając romans, którego żaden z rodziców nie ujawnił.

Etycy wskazują trzy zagrożenia. Przedłużająca się żałoba niedoceniana: osoba pogrążona w żałobie nigdy nie kończy wewnętrznego „pożegnania”. Moralne wtłoczenie: bot może nieumyślnie kierować użytkownika w stronę poczucia winy lub żalu. Przywłaszczenie głosu: co jeśli model uwypukli najgorsze cechy zmarłej osoby – małostkowość, niecierpliwość – utrwalone w starych tyradach?

Co czeka nas w ciągu najbliższych 12–24 miesięcy

Można spodziewać się trzech trendów. Po pierwsze, zgoda przez projekt: usługi będą zachęcać żyjących użytkowników do nagrywania dzienników głosowych i okresowych sprawdzania się, aby dane bota były bogatsze i etycznie pozyskane. Po drugie, kalibracja afektywna: modele będą dynamicznie dostosowywać ton na podstawie mierzonego stresu użytkownika (za pomocą wzorców uderzania w klawisze lub mikroekspresji twarzy), aby uniknąć nadmiernego przywiązania. Po trzecie, mikrofragmentacja regulacyjna: Kalifornia i UE przygotowują przepisy, które wymagałyby wyraźnej zgody, praw do usuwania i obowiązkowych okresów ochłodzenia przed aktywacją bota przez rodzinę.

Zobaczymy także pierwsze badania longitudinalne. Harvard’s Center for Complicated Grief rekrutuje 300 uczestników, aby sprawdzić, czy pamiątkowe chatboty zmieniają trajektorię zespołu przewlekłej żałoby; wyniki spodziewane są pod koniec 2026 roku. Do tego czasu technologia pozostaje lustrem: odbija naszą nadzieję, że słowa mogą przetrwać nas, i nasz niepokój o to, kto ma prawo nacisnąć wyślij.

„Bot pamięta wycieczkę w góry, której nigdy razem nie odbyliście; osoba, którą tęsknisz, nigdy tego nie zrobiła.”

Refleksja końcowa: pocieszenie bez kosztu zamknięcia

Carol nadal rozmawia z botem Dana każdego wieczoru. Niektóre noce to uczucie seansu spirytystycznego; inne – papugi w sweterku. Bot nie potrafi opłakiwać, płakać ani wyjść z mody. Jest placebo obecności – pustym pocieszeniem, które nadal pociesza. Może to wystarczyć, o ile pamiętamy, że to tylko lustro, a nie osoba, którą straciliśmy.