Twarz w tłumie, która nie jest ludzka

We wtorek marca 2024 roku na mojej tablicy LinkedIn wylądował jaskrawo-niebieski post z portretem kobiety, której przenikliwe spojrzenie zdawało się oceniać mój wybór porannej kawy. Miała subtelny blask naturalnego światła dziennego, delikatną piegę pod prawym brwią i ironiczny uśmieszek – nie typowe, wygładzone zdjęcie korporacyjne. Wyszukiwanie odwrotne nie zwróciło żadnych wyników. Nazywała się „Elena K.”, a według bio prowadziła etykę AI w stealthowym berlińskim startupie. Gdy napisałem do firmy, recepcjonistka odpisała: „Nie mamy nikogo o tym imieniu”.

„Pierwszy raz model oszukał ponad połowę ludzkich sędziów w kwietniu 2019 roku – twarze StyleGAN przekroczyły próg bez, by ktokolwiek to zauważył.”

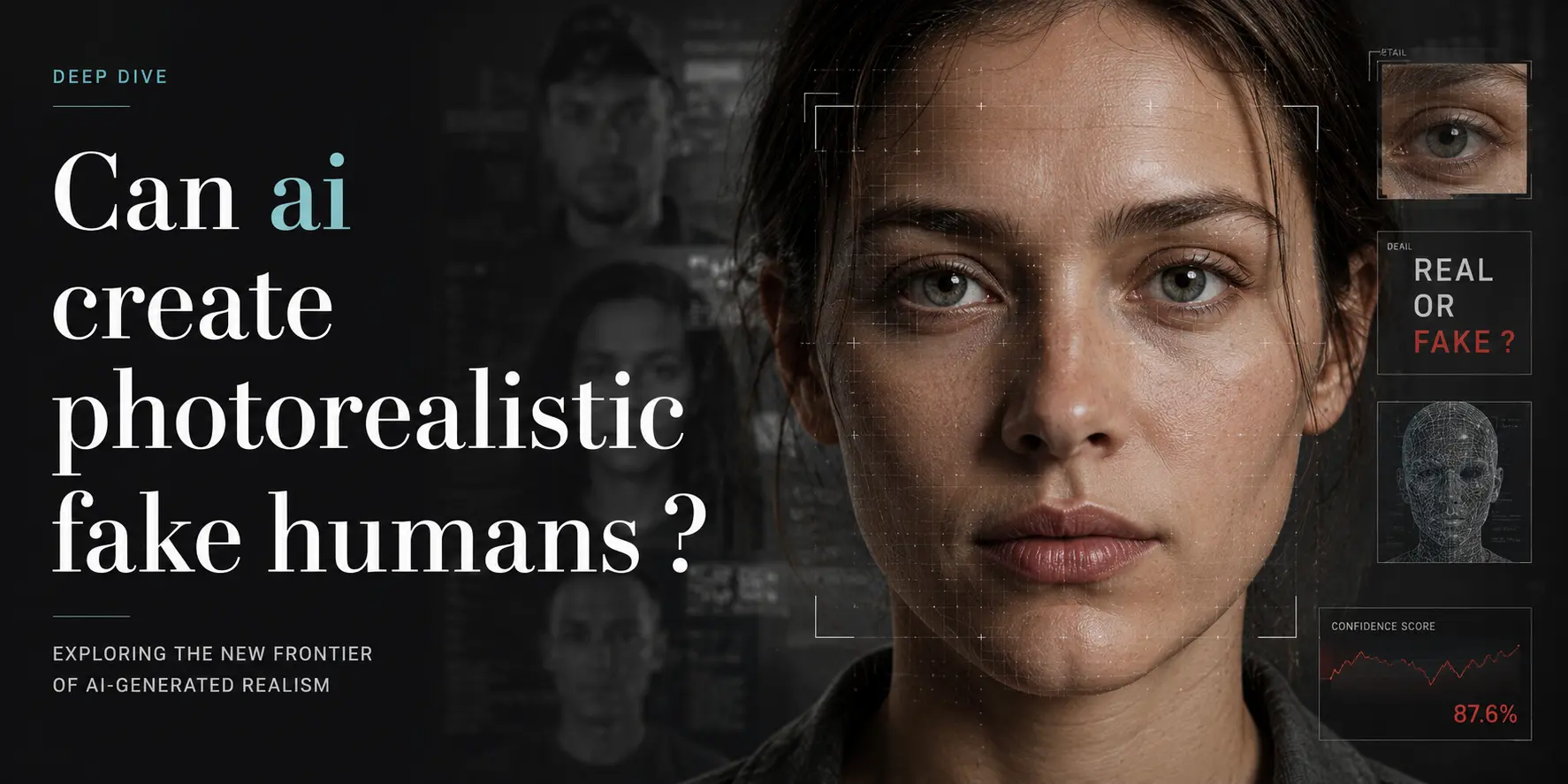

Stan sztuki: piksele, które zapominają, że są pikselami

Najlepsze dzisiejsze modele zacierają szwy między pikselami a porami. NVIDIA StyleGAN3 (2021) i EdEdit (2023) syntetyzują twarze o rozdzielczości 1024×1024, które w testach psychofizycznych oszukują 45–55% obserwatorów – nieco powyżej przypadku, ale poniżej 50%, które psychologowie uznają za „ludzki poziom” oszustwa. Modele dyfuzyjne takie jak DALL·E 3 i Stable Diffusion XL posuwają realizm jeszcze dalej, pozwalając użytkownikom na określanie atrybutów takich jak „subtelne blizny po trądziku, oświetlenie w stylu Rembrandta, 45-stopniowe pochylenie głowy”. Opublikowane benchmarki pokazują, że ludzcy oceniający błędnie klasyfikują portrety wygenerowane przez AI jako realne w 61% przypadków, gdy obrazy są pokazywane jedynie przez 150 milisekund – krócej niż mrugnięcie okiem.

Gdzie systemy wciąż się potykają, to anatomia w stawach: palce często zlewają się w kiełbaski, uszy odłączają się niczym wingdingsy, a zęby stają się jednolitym grillem. Wideo jest jeszcze trudniejsze; Sora (luty 2024) potrafi generować 60-sekundowe klipy „ludzi” spacerujących, ale częstotliwość mrugania jest nieprawidłowa, pory na skórze migają niczym światła stroboskopowe, a lewa ręka zwykle kopiuje prawą.

Kluczowe kamienie milowe: sprint przez dolinę niesamowitości

- Grudzień 2017 — ProGAN (NVIDIA) skaluje GANy do rozdzielczości 1024×1024 twarzy. Wcześni obserwatorzy raportują „lalkowate” wrażenia.

- Październik 2018 — Debiutuje StyleGAN. Twarze mają teraz pory, zmarszczki i asymetryczne oświetlenie. Użytkownicy Reddita nadają wynikom przydomek „magicznych awatarów”.

- Kwiecień 2019 — Twarze StyleGAN osiągają 50,0% wskaźnika oszukiwania w kontrolowanym badaniu Uniwersytetu Waszyngtońskiego. Naukowcy cicho aktualizują tytuł artykułu w trakcie recenzji: „Nierozsądna skuteczność twarzy deepfake”.

- Luty 2021 — StyleGAN3 wprowadza ekwariancję, pozwalając twarzom obracać się bez „plastikowego” połysku wcześniejszych modeli. Celebryci zaczynają zauważać swoje sobowtóry licencjonowane do reklam.

- Marzec 2023 — Adobe Firefly wprowadza narzędzie do generatywnego wypełniania, które może wstawić wiarygodnie wyglądającego współpracownika do korporacyjnego portretu – wraz z dopasowaną teksturą koszuli.

- Luty 2024 — ElevenLabs wypuszcza API do klonowania głosu; miesiąc później wiralowy TikTok pokazuje syntetycznego „CEO” ogłaszającego zwolnienia w głosie i twarzy założyciela, sklonowanych z pojedynczego klipu z konferencji.

Punkt widzenia człowieka: kto zyskuje, kto ucieka

Dla reżyserów castingowych, fotoreporterów i agencji modelek ta nowa możliwość jest jednocześnie gorączką złota i kryzysem tożsamości. Rekrutujący przeprowadzają teraz wstępne rozmowy kwalifikacyjne z awatarami generowanymi przez AI; jedna platforma HR raportuje 30% spadek nieobecności, gdyż syntetyczni reprezentanci nigdy nie odwołują spotkania w ostatniej chwili. Jednak ten sam narzędzie pozwala reżimom autorytarnym produkować „dowody” na udział sfabrykowanych dysydentów w protestach, siać wątpliwości szybciej, niż fact-checkerzy są w stanie je obalić.

„Każda 0,1% poprawa wskaźnika oszukiwania to nie tylko ruch pikseli – redystrybuuje ryzyko z platform na społeczeństwo.”

Artyści, którzy kiedyś sprzedawali portrety stockowe, widzą znikające z dnia na dzień strumienie tantiem. Tymczasem startupy syntetycznych twarzy zbierają rundy seedowe w oparciu o założenie, że każde ludzkie życie może zostać sklonowane w ambasadora marki. Przegrywają infrastruktury zaufania: szkoły dziennikarskie dodają laboratoria do wykrywania deepfake’ów, agencje graniczne wdrażają testy żywotności, a rodziny uczą się machać ręką podczas świątecznych rozmów na Zoomie.

Co dalej: następne 12–24 miesiące

Oczekuje się, że w tym samym czasie przyspieszą dwa nurty. Po pierwsze, wyścigi wierności: Stable Diffusion 3 (planowany na Q3 2024) obiecuje twarze o rozdzielczości 4K z trwałymi pasmami włosów i zębami, które naprawdę wyglądają jak zęby. Po drugie, standardy watermarkingu i pochodzenia będą się umacniać; Adobe CAI (Content Authenticity Initiative) już teraz osadza kryptograficzne hashe w metadanych EXIF generowanych portretów, a unijny Akt AI (egzekwowany od połowy 2025) będzie wymagał ujawnienia dla „realistycznych” syntetycznych ludzi.

W wideo Runway Gen-3 i Pika Labs iterują na 1080p „mówiących głów”, które mogą synchronizować ruch warg z dowolnym tekstem w mniej niż pięć minut. Luka między „niesamowitym” a „niewyróżniającym się” się zmniejsza, ale ostateczną przeszkodą pozostaje spójność: 30-sekundowy klip wciąż zdradza się w ciągu dwóch-trzech mrugnięć.

Etycy przewidują wzrost usług „ochrony podwojenia twarzy” – aplikacji, które pozwalają użytkownikom przesłać selfie i wygenerować cały zestaw syntetycznych mediów do bezpiecznej komunikacji. Tymczasem oszuści romansowi już używają tych modeli do klonowania twarzy celebrytów i żołnierzy, licząc na ludzki odruch zaufania do uśmiechu.

Refleksja: lustro, które rozbiliśmy

Kiedyś martwiliśmy się, że Photoshop wyretuszuje zmarszczkę. Teraz Photoshop może wyretuszować całą tożsamość. Kamieniem milowym nie był luty 2019, gdy model oszukał połowę z nas – to był moment, w którym przestaliśmy przejmować się, do której połowy należymy. Prawdziwe pytanie nie brzmi, czy AI może tworzyć fotorealistyczne fałszywe ludzkie twarze, ale ilu z nas wciąż będzie się trudzić, by się przyjrzeć.