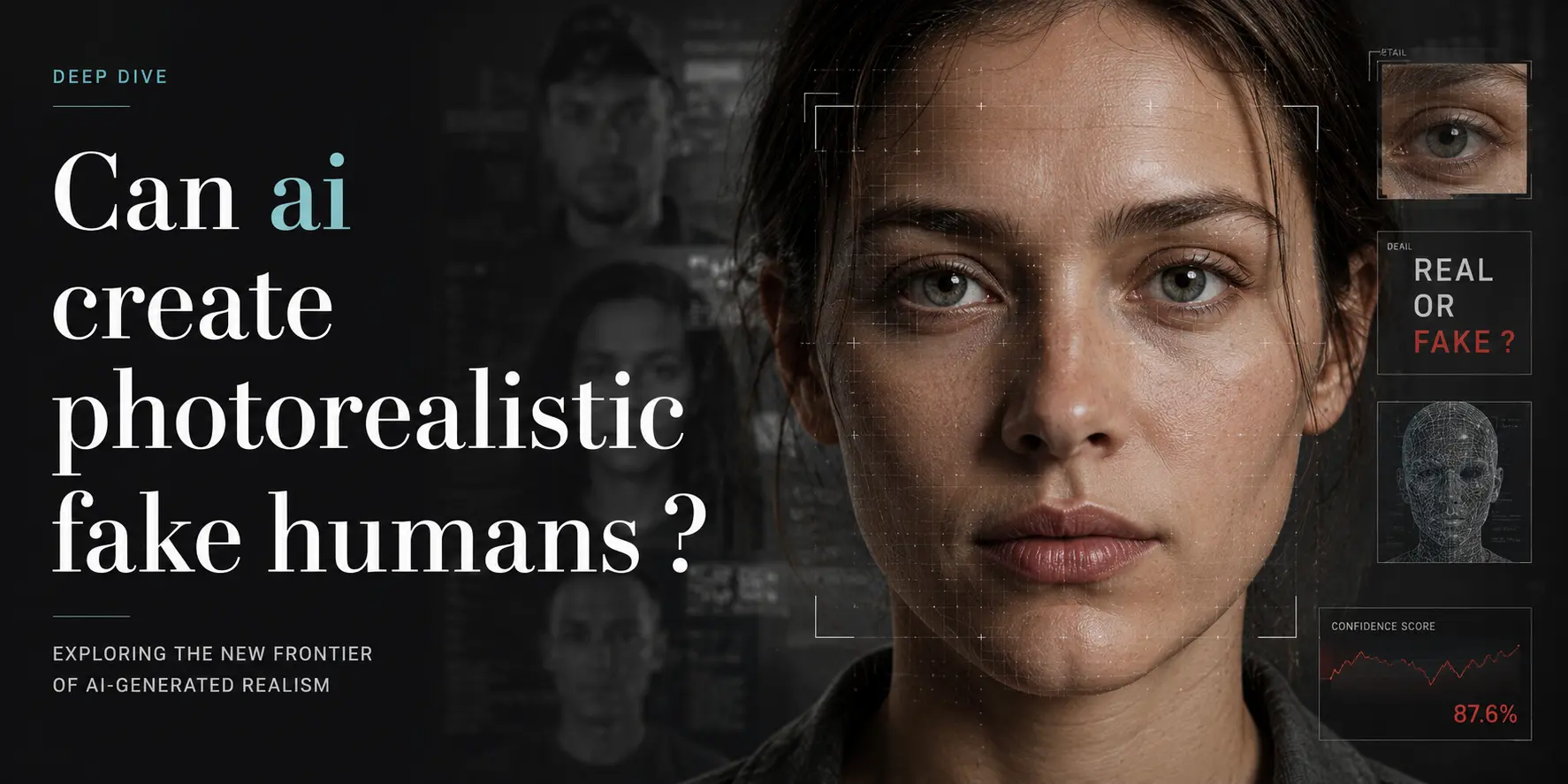

Chipul din mulțime care nu este uman

Marți, în martie 2024, un post pe LinkedIn de culoare albastru-azuriu a apărut în fluxul meu, cu o poză de profil a unei femei al cărei privire părea să judece alegerea mea de cafea de dimineață. Avea o strălucire subtilă a luminii naturale de la fereastră, un pistrui ușor sub sprânceana dreaptă și un zâmbet ironic — nu poza corporatistă obișnuită și lustruită. O căutare inversă a imaginii nu a returnat nimic. Numele ei era „Elena K.” și, conform bio-ului, conducea etica AI la o companie de start-up din Berlin care opera în secret. Când am trimis un mesaj la companie, recepționera a răspuns: „Nu avem pe nimeni cu acest nume.”

„Prima dată când un model a înșelat mai mult de jumătate dintre judecătorii umani a fost în aprilie 2019 — fețele generate de StyleGAN au depășit pragul fără ca cineva să observe.”

Starea artei: pixeli care uită că sunt pixeli

Cele mai bune modele de astăzi estompează granițele dintre pixeli și pori. StyleGAN3 (2021) și EdEdit (2023) de la NVIDIA sintetizează fețe de 1024×1024 care, în teste psihofizice, înșală 45–55 % dintre privitori — chiar peste șansă, dar sub pragul de 50 % considerat de psihologi „înșelătorie la nivel uman”. Modelele de difuzie precum DALL·E 3 și Stable Diffusion XL duc realismul mai departe, permițând utilizatorilor să introducă atribute precum „cicatrici ușoare de acnee, iluminare Rembrandt, înclinare a capului de 45 de grade”. Benchmark-urile publicate arată că evaluatorii umani clasifică greșit portretele generate de AI ca reale în 61 % din cazuri când imaginile sunt prezentate doar 150 de milisecunde — mai puțin decât o privire.

Unde sistemele încă greșesc este anatomia la nivelul articulațiilor: degetele se contopeau adesea în „cârnați”, urechile se desprindeau ca niște simboluri wingdings, iar dinții deveneau o grilă monocromă. Video-ul este și mai dificil; Sora (februarie 2024) poate genera clipuri de 60 de secunde cu „persoane” care merg, dar rata de clipire este greșită, porii pielii pâlpâie ca niște lumini stroboscopice, iar mâna stângă de obicei copiază pe cea dreaptă.

Repere cheie: sprintul în Valea Straniu

- Decembrie 2017 — ProGAN (NVIDIA) scalează GAN-urile la fețe de 1024×1024. Privitorii timpurii raportează senzații de „păpușă înfricoșătoare”.

- Octombrie 2018 — StyleGAN debutează. Fețele au acum pori, riduri și iluminare asimetrică. Utilizatorii de pe Reddit poreclesc rezultatele „avataruri magice”.

- Aprilie 2019 — Fețele StyleGAN ating rata de înșelare de 50,0 % într-un studiu controlat de Universitatea din Washington. Cercetătorii actualizează discret titlul lucrării de referință pe parcursul revizuirii: „Eficacitatea nerezonabilă a fețelor deepfake”.

- Februarie 2021 — StyleGAN3 introduce echivarianța, permițând fețelor să se rotească fără strălucirea „plastică” a modelelor anterioare. Celebritățile încep să observe că dublurile lor sunt licențiate pentru reclame.

- Martie 2023 — Adobe Firefly lansează un instrument de generare a umplerii cu elemente sintetice care poate insera un coleg plauzibil într-o poză de profil corporatistă — complet cu textura cămașii potrivită.

- Februarie 2024 — ElevenLabs lansează o API de clonare vocală; o lună mai târziu, un TikTok viral arată un „CEO” sintetic care anunță concedieri în vocea și chipul fondatorului, clonat dintr-un singur clip de apel de venituri.

Perspectiva umană: cine câștigă, cine se împrăștie

Pentru regizorii de casting, fotojurnaliști și agenții de modele, această nouă capacitate este simultan o goană după aur și o criză de identitate. Recruiterii efectuează acum interviuri cu candidați prin intermediul înlocuitorilor sintetici pentru selecția inițială; o platformă de resurse umane raportează o scădere de 30 % a absențelor la interviuri pentru că avatarele sintetice nu anulează niciodată în ultimul moment. Totuși, același instrument permite regimurilor autoritare să producă „probe” cu disidenți fabricați prezenți la proteste, semănând îndoiala mai repede decât verificatorii de fapte pot demonta.

„Fiecare îmbunătățire de 0,1 % a ratei de înșelare nu mută doar pixeli — redistribuie riscul de la platforme către public.”

Artiștii care vindeau odată portrete de stoc văd veniturile din drepturi de autor dispărând peste noapte. Între timp, start-up-urile de fețe sintetice strâng runde de finanțare pe premisa că fiecare viață umană poate fi clonată într-un ambasador de marcă. Cei care pierd sunt infrastructurile de încredere: școlile de jurnalism adaugă laboratoare de detectare a deepfake-urilor, agențiile de frontieră utilizează teste de autenticitate, iar familiile învață să facă un gest cu mâna în timpul apelurilor Zoom de sărbători.

Ce urmează: următorii 12–24 de luni

Se așteaptă ca două direcții să accelereze în paralel. În primul rând, cursele de fidelitate: Stable Diffusion 3 (programat pentru Q3 2024) promite fețe la rezoluție 4K cu fire de păr stabile și dinți care arată ca dinți reali. În al doilea rând, standardele de marcaj și proveniență vor deveni mai stricte; inițiativa CAI (Content Authenticity Initiative) a Adobe deja încorporează hash-uri criptografice în metadatele EXIF ale portretelor generate, iar Legea AI a UE (aplicabilă din mijlocul anului 2025) va impune dezvăluirea pentru „umani sintetici realiști”.

În video, Runway Gen-3 și Pika Labs iterează clipuri de „cap vorbitor” la 1080p care pot sincroniza buzele cu orice scenariu în mai puțin de cinci minute. Decalajul dintre „straniu” și „neobservabil” se micșorează, dar obstacolul final rămâne consistența: un clip de 30 de secunde se trădează încă în două sau trei clipiri.

Eticienii prevăd o creștere a serviciilor de „protecție a feței dublate” — aplicații care permit utilizatorilor să încarce o poză de profil și să genereze un întreg kit media sintetic pentru comunicări sigure. Între timp, escrocii romantici folosesc deja aceste modele pentru a clone chipurile celebrităților și soldaților, bazându-se pe reflexul uman de a avea încredere într-un zâmbet frumos.

Reflecție: oglinda pe care am spart-o

Odinioară ne îngrijoram că Photoshopul îndepărtează o ridă. Acum Photoshopul poate crea o identitate întreagă din nimic. Momentul-cheie nu a fost februarie 2019, când modelul i-a înșelat pe jumătate dintre noi — a fost momentul în care am încetat să mai conteze cărei jumătăți aparținem. Întrebarea reală nu este dacă AI poate crea oameni falși fotorealistici, ci câți dintre noi vor mai avea chef să se uite.