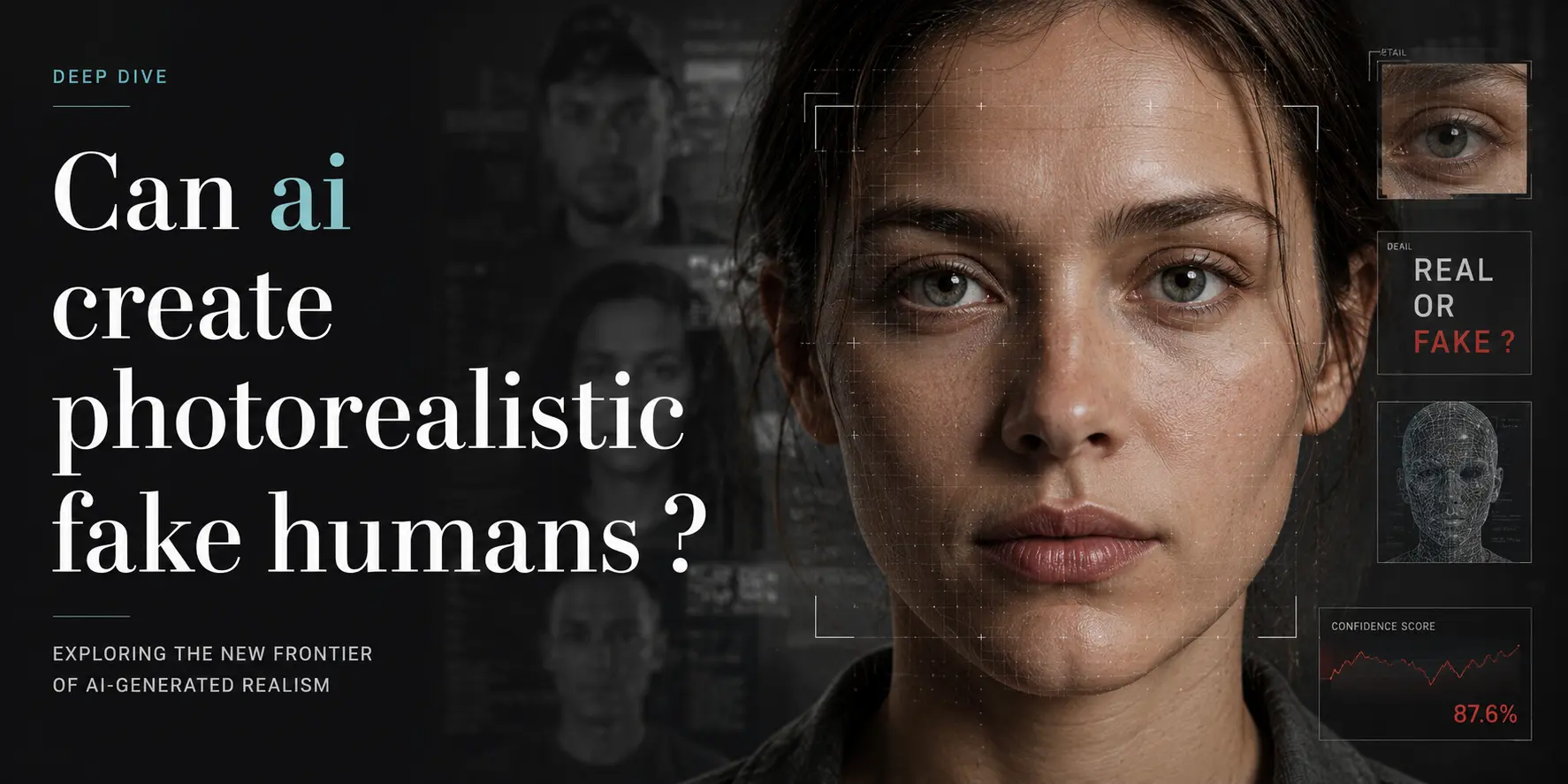

O rosto na multidão que não é humano

Numa terça-feira de março de 2024, uma publicação azul-celeste no LinkedIn chegou ao meu feed com um retrato de uma mulher cujo olhar perscrutador parecia julgar a minha escolha de café da manhã. Ela tinha o brilho subtil da luz natural de uma janela, uma sarda ténue abaixo da sobrancelha direita e um sorriso de piadista — não a habitual foto corporativa polida. Uma pesquisa de imagem inversa não devolveu resultados. O nome dela era “Elena K.” e, segundo a biografia, liderava a ética de IA numa startup stealth de Berlim. Quando enviei uma mensagem à empresa, a rececionista respondeu: “Não temos ninguém com esse nome.”

"A primeira vez que um modelo enganou mais de metade dos juízes humanos foi em abril de 2019 — os rostos do StyleGAN ultrapassaram o limiar sem que ninguém desse por isso."

Estado da arte: píxeis que esquecem que são píxeis

Os melhores modelos atuais apagam as costuras entre píxeis e poros. O StyleGAN3 (2021) e o EdEdit (2023) da NVIDIA sintetizam rostos de 1024×1024 que, em testes psicofísicos, enganam 45–55 % dos espectadores — apenas acima do acaso, mas abaixo dos 50 % que os psicólogos consideram uma “deceção ao nível humano”. Modelos de difusão como o DALL·E 3 e o Stable Diffusion XL levam o realismo mais longe ao permitirem que os utilizadores especifiquem atributos como “cicatrizes subtis de acne, iluminação de Rembrandt, inclinação da cabeça a 45 graus”. Os benchmarks publicados mostram que avaliadores humanos classificam erradamente retratos gerados por IA como reais 61 % das vezes quando as imagens são mostradas durante apenas 150 milissegundos — menos do que um olhar rápido.

Onde os sistemas ainda tropeçam é na anatomia das articulações: os dedos muitas vezes se fundem em salsichas, as orelhas desprendem-se como caracteres de asa, e os dentes tornam-se uma grelha monocromática. O vídeo é ainda mais difícil; o Sora (fevereiro de 2024) consegue gerar clipes de 60 segundos de “pessoas” a caminhar, mas a frequência de piscar está errada, os poros da pele tremeluzem como luzes estroboscópicas e a mão esquerda geralmente copia a direita.

Marcos-chave: a corrida pelo vale da estranheza

- Dezembro de 2017 — O ProGAN (NVIDIA) escala GANs para rostos de 1024×1024. Os primeiros espectadores relatam vibes de “boneca assustadora”.

- Outubro de 2018 — O StyleGAN estreia. Os rostos agora têm poros, rugas e iluminação assimétrica. Utilizadores do Reddit alcunham os resultados de “avatares mágicos”.

- Abril de 2019 — Os rostos do StyleGAN atingem a taxa de engano de 50,0 % num estudo controlado pela Universidade de Washington. Os investigadores atualizam discretamente o título do artigo do benchmark a meio da revisão: “A Eficácia Incomum de Rostos Deepfake”.

- Fevereiro de 2021 — O StyleGAN3 introduz a equivariância, permitindo que os rostos rodem sem o brilho “plástico” dos modelos anteriores. Celebridades começam a notar os seus duplos a licenciarem-se para anúncios.

- Março de 2023 — A Adobe Firefly lança uma ferramenta de preenchimento generativo que consegue inserir um colega plausível num retrato corporativo — completo com textura de camisa a condizer.

- Fevereiro de 2024 — A ElevenLabs lança uma API de clonagem de voz; um mês depois, um TikTok viral mostra um “CEO” sintético a anunciar despedimentos com a voz e rosto do fundador, clonados a partir de um único clipe de teleconferência de resultados.

O ângulo humano: quem ganha, quem se dispersa

Para diretores de casting, fotojornalistas e agências de modelos, esta nova capacidade é simultaneamente uma corrida ao ouro e uma crise de identidade. Os recrutadores entrevistam agora candidatos através de substitutos gerados por IA em triagens iniciais; uma plataforma de RH relata uma queda de 30 % nos não comparecimentos porque os avatares sintéticos nunca cancelam em cima da hora. Contudo, a mesma ferramenta permite que regimes autoritários produzam “provas” de dissidentes fabricados a participar em manifestações, semeando dúvidas mais rápido do que os fact-checkers conseguem desmentir.

"Cada melhoria de 0,1 % na taxa de engano não move apenas píxeis — redistribui o risco das plataformas para o público."

Artistas que outrora vendiam retratos de stock veem as suas receitas evaporarem-se da noite para o dia. Enquanto isso, startups de rostos sintéticos angariam rondas de seed com a premissa de que cada vida humana pode ser clonada num embaixador de marca. Os perdedores são as infraestruturas de confiança: escolas de jornalismo adicionam laboratórios de deteção de deepfakes, agências de fronteira implementam testes de vivacidade e famílias aprendem a acenar com a mão nas chamadas Zoom de Natal.

O que vem a seguir: os próximos 12–24 meses

Espera-se que duas linhas acelerem em paralelo. Em primeiro lugar, corridas pela fidelidade: o Stable Diffusion 3 (previsto para o 3.º trimestre de 2024) promete rostos em 4K com fios de cabelo estáveis e dentes que realmente parecem dentes. Em segundo lugar, os padrões de marcação e proveniência irão endurecer; a iniciativa CAI (Content Authenticity Initiative) da Adobe já incorpora hashes criptográficos nos metadados EXIF de retratos gerados, e o Regulamento de IA da UE (aplicável a partir de meados de 2025) exigirá divulgação para “humanos sintéticos realistas”.

No vídeo, o Runway Gen-3 e o Pika Labs estão a iterar em clipes de “cabeças falantes” em 1080p que conseguem sincronizar lábios com qualquer roteiro em menos de cinco minutos. A lacuna entre “estranho” e “irrelevante” está a diminuir, mas o derradeiro obstáculo continua a ser a consistência: um clipe de 30 segundos ainda se trai em duas ou três piscadelas.

Os éticos preveem um surto de serviços de “proteção de duplicação de rosto” — aplicações que permitem aos utilizadores fazer upload de um selfie e gerar um kit completo de media sintético para comunicações seguras. Entretanto, os burlões de romance já usam estes modelos para clonar os rostos de celebridades e soldados, contando com o reflexo humano de confiar num sorriso bonito.

Reflexão: o espelho que partimos

Antes preocupávamo-nos com o Photoshop a eliminar uma ruga. Agora, o Photoshop consegue eliminar uma identidade inteira. O marco não foi fevereiro de 2019, quando o modelo enganou metade de nós — foi o momento em que deixámos de nos importar a que metade pertencíamos. A verdadeira questão não é se a IA consegue criar humanos falsos fotorrealistas, mas quantos de nós ainda se darão ao trabalho de olhar.