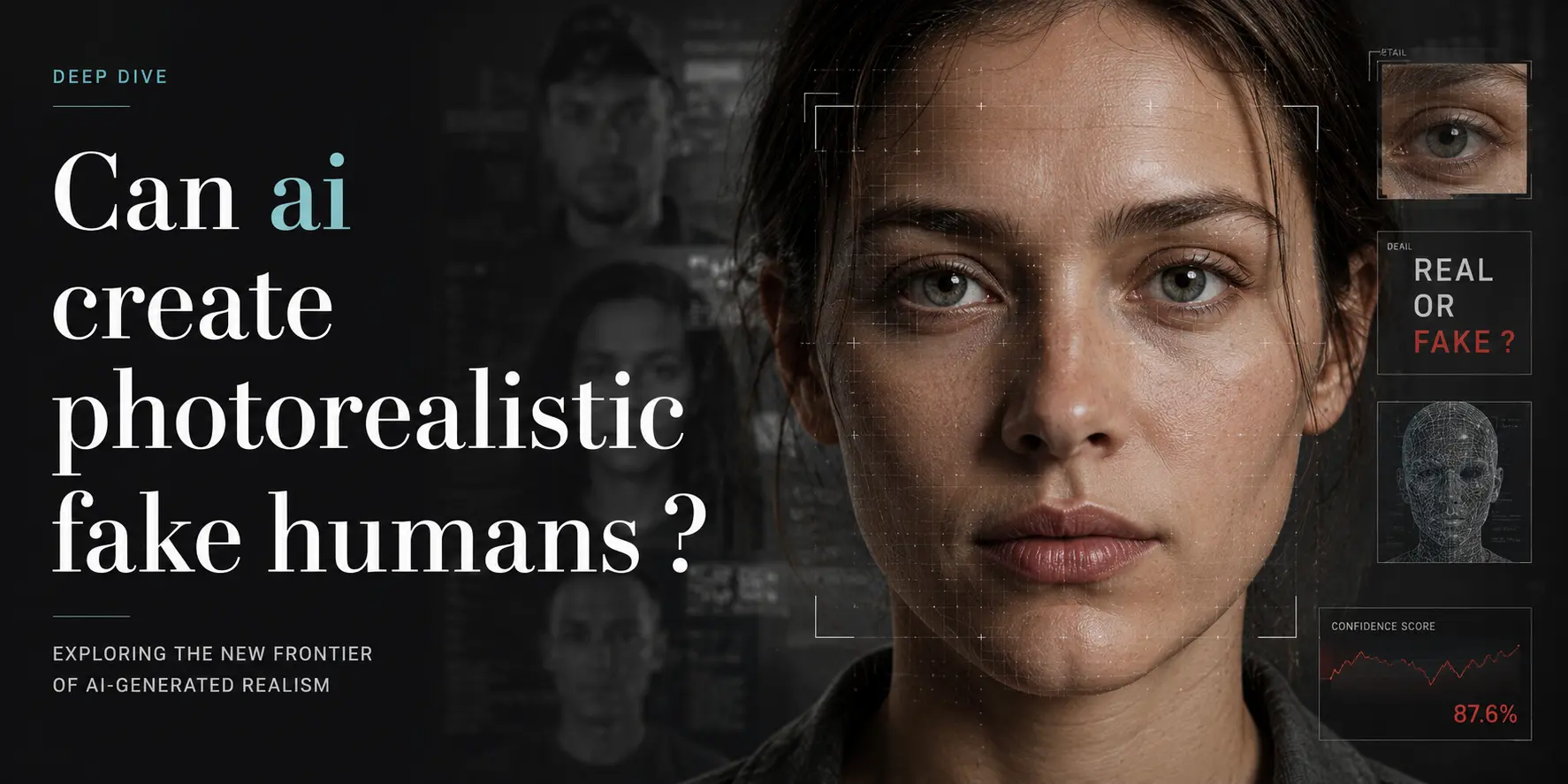

Het gezicht in de menigte dat niet menselijk is

Op een dinsdag in maart 2024 landde een hemelsblauwe LinkedIn-post in mijn feed met een portretfoto van een vrouw wier scherpe blik mijn keuze voor de ochtendkoffie leek te beoordelen. Ze had het subtiele schijnsel van natuurlijk raamlicht, een vaag sproetje onder haar rechterwenkbrauw en een grijns van een grapjas – niet de gebruikelijke gepolijste stockfoto van een bedrijf. Een zoekopdracht met omgekeerd beeld leverde niets op. Haar naam was “Elena K.” en volgens haar bio leidde ze AI-ethiek bij een geheimzinnige Berlijnse startup. Toen ik het bedrijf een bericht stuurde, antwoordde de receptionist: “We hebben niemand met die naam.”

"De eerste keer dat een model meer dan de helft van de menselijke jury’s voor de gek hield was april 2019 – de gezichten van StyleGAN passeerden de drempel zonder dat iemand het merkte."

Stand van zaken: pixels die vergeten dat ze pixels zijn

De beste modellen van vandaag wissen de naden tussen pixels en poriën uit. NVIDIA’s StyleGAN3 (2021) en EdEdit (2023) synthetiseren gezichten van 1024×1024 pixels die in psychofysische tests 45–55 % van de kijkers voor de gek houden – net boven toeval, maar onder de 50 %-drempel die psychologen als “menselijk niveau” van bedrog beschouwen. Diffusiemodellen zoals DALL·E 3 en Stable Diffusion XL duwen de realisme verder door gebruikers toe te staan eigenschappen te specificeren zoals “subtiele acne littekens, Rembrandt-verlichting, 45-graden hoofdkanteling”. Uitgebrachte benchmarks tonen aan dat menselijke evaluatoren AI gegenereerde portretten als echt bestempelen in 61 % van de gevallen wanneer de afbeeldingen slechts 150 milliseconden worden getoond – korter dan een blik.

Waar de systemen nog struikelen is de anatomie bij de gewrichten: vingers smelten vaak samen tot worsten, oren laten los als wingdings en tanden worden een monochrome tralies. Video is nog moeilijker; Sora (feb 2024) kan 60-seconden clips genereren van “mensen” die lopen, maar de knipperfrequentie klopt niet, huidporiën flikkeren als stroboscooplampen en de linkerhand kopieert meestal de rechter.

Belangrijke mijlpalen: de sprint door de onheimelijke vallei

- December 2017 — ProGAN (NVIDIA) schaalt GAN’s op naar 1024×1024 gezichten. Vroege kijkers melden “eng poppen”-vibes.

- Oktober 2018 — StyleGAN debuteert. Gezichten hebben nu poriën, rimpels en asymmetrische verlichting. Reddit-gebruikers noemen de resultaten “magische avatars”.

- April 2019 — De gezichten van StyleGAN bereiken een fooling-rate van 50,0 % in een gecontroleerde studie van de Universiteit van Washington. Onderzoekers passen de titel van het benchmark-artikel halverwege de review stilletjes aan: “The Unreasonable Effectiveness of Deepfake Faces”.

- Februari 2021 — StyleGAN3 introduceert equivariantie, waardoor gezichten kunnen roteren zonder het “plastic” schijnsel van eerdere modellen. Celebrities beginnen hun dubbelgangers op te merken die zichzelf licentiëren voor advertenties.

- Maart 2023 — Adobe Firefly brengt een generatieve-vultool op de markt die een plausibele collega in een bedrijfsportret kan plaatsen – compleet met bijpassende shirttextuur.

- Februari 2024 — ElevenLabs brengt een stemkloner-API uit; een maand later laat een virale TikTok een synthetische “CEO” ontslagen aankondigen in de stem en het gezicht van de oprichter, gekloond uit een enkel winst-en-verliesverhaalfragment.

Het menselijke aspect: wie wint, wie verspreidt zich

Voor casting directors, fotojournalisten en modellenbureaus is deze nieuwe mogelijkheid tegelijkertijd een goudkoorts en een identiteitscrisis. Recruiters voeren nu sollicitatiegesprekken via AI gegenereerde stand-ins voor de eerste screening; één HR-platform meldt een daling van 30 % in no-shows omdat synthetische avatars nooit op het laatste moment afzeggen. Toch stelt hetzelfde hulpmiddel autoritaire regimes in staat “bewijs” te fabriceren van vermeende dissidenten die aan protesten deelnemen, waardoor twijfel sneller zaait dan factcheckers kunnen ontkrachten.

"Elke 0,1 %-verbetering in de fooling-rate verplaatst niet alleen pixels – het herverdeelt risico van platforms naar het publiek."

Kunstenaars die ooit stockportretten verkochten zien hun inkomstenstromen ’s nachts verdampen. Ondertussen halen startups in synthetische gezichten seed rounds binnen op de belofte dat elk mensenleven gekloond kan worden tot een merkambassadeur. De verliezers zijn de vertrouwensinfrastructuren: journalistieke scholen voegen deepfake-detectielabs toe, grensbewakingen zetten levendigheidstests in en families leren hun hand voor een kerst-Zoom te zwaaien.

Wat komt er aan: de komende 12–24 maanden

Er zijn twee sporen te verwachten die parallel versnellen. Ten eerste de wapenwedloop in precisie: Stable Diffusion 3 (gepland Q3 2024) belooft gezichten van 4K-resolutie met stabiele haarstrengen en snijtanden die er echt uitzien als tanden. Ten tweede zullen watermerken en herkomststandaarden verharden; Adobe’s CAI (Content Authenticity Initiative) embedt al cryptografische hashes in gegenereerde portret-EXIF en de EU AI Act (afdwingbaar medio 2025) zal openbaarmaking vereisen voor “realistische” synthetische mensen.

In video werken Runway Gen-3 en Pika Labs aan 1080p “pratende hoofden”-clips die in minder dan vijf minuten kunnen lip-syncen naar elk script. De kloof tussen “onheimelijk” en “onopvallend” wordt kleiner, maar de ultieme horde blijft consistentie: een 30-seconden clip verraadt zichzelf nog steeds binnen twee of drie knipperingen.

Ethici voorspellen een golf aan “gezichtverdubbelings”-beschermingsdiensten – apps die gebruikers toestaan een selfie te uploaden en een volledige synthetische mediakit te genereren voor veilige communicatie. Ondertussen gebruiken oplichtingscriminelen deze modellen al om de gezichten van beroemdheden en soldaten te klonen, vertrouwend op de menselijke reflex om een mooie glimlach te vertrouwen.

Reflectie: de spiegel die we hebben gebroken

Vroeger maakten we ons zorgen dat Photoshop een rimpel wegpoetste. Nu kan Photoshop een hele identiteit uit het niets creëren. De mijlpaal was niet februari 2019, toen het model de helft van ons voor de gek hield – het was het moment waarop we stopten met ons af te vragen tot welke helft we behoorden. De echte vraag is niet of AI realistische nep-mensen kan maken, maar hoeveel van ons nog de moeite zullen nemen om te kijken.