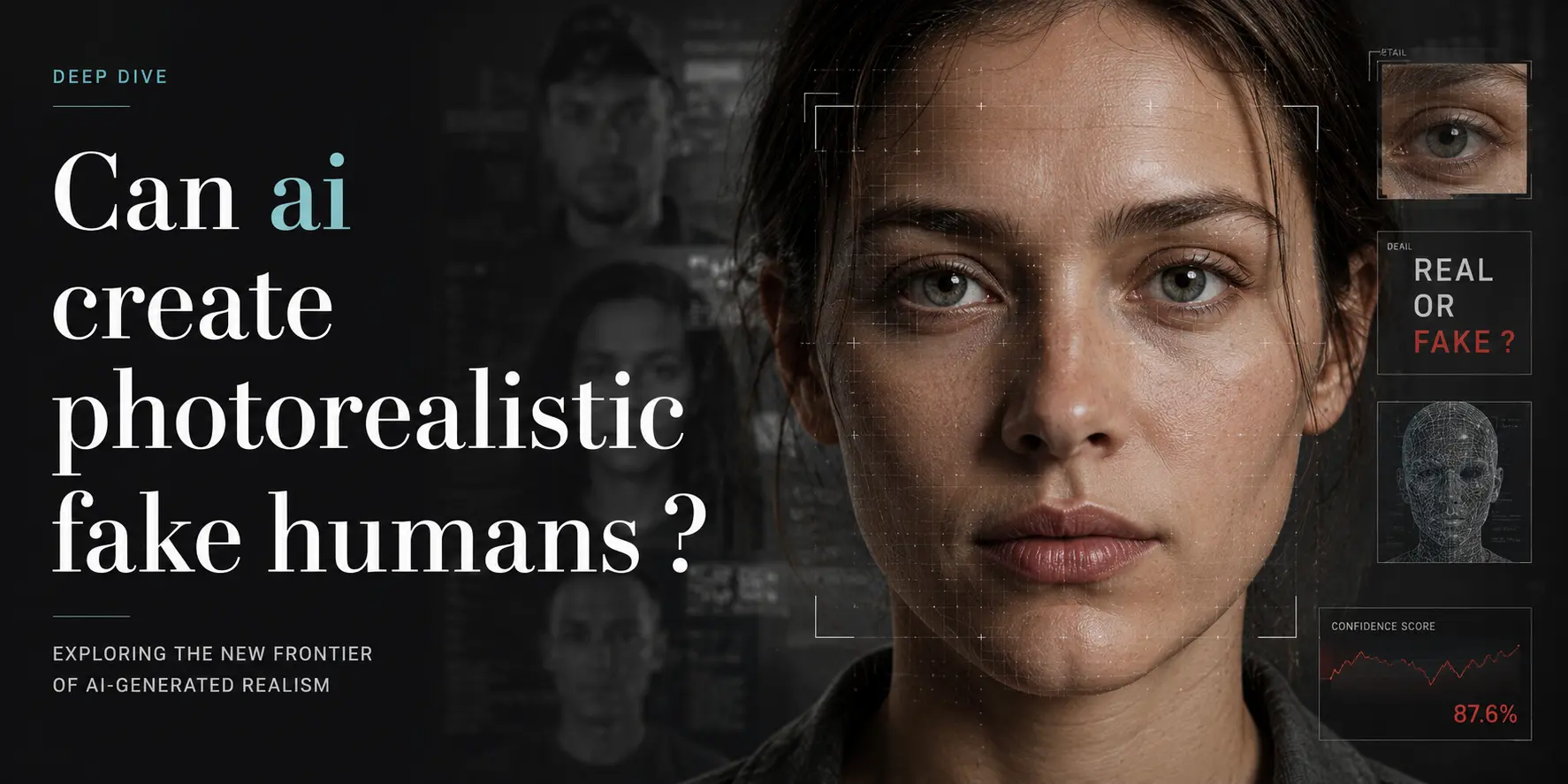

Il volto tra la folla che non è umano

Martedì marzo 2024, un post su LinkedIn di un blu acceso è atterrato nella mia bacheca con una foto di una donna il cui sguardo acuto sembrava giudicare la mia scelta del caffè del mattino. Aveva il sottile bagliore della luce naturale del sole, una lieve lentiggine sotto il sopracciglio destro e un sorriso malizioso da battuta spiritosa: non la solita foto aziendale patinata. Una ricerca inversa di immagini non ha restituito nulla. Il suo nome era “Elena K.” e, secondo la biografia, guidava l’etica dell’IA in una startup berlinese in stealth mode. Quando ho scritto all’azienda, la receptionist ha risposto: “Non abbiamo nessuno con quel nome.”

"La prima volta che un modello ha ingannato più della metà dei giudici umani è stato aprile 2019: i volti di StyleGAN hanno superato la soglia senza che nessuno se ne accorgesse."

Stato dell’arte: pixel che dimenticano di essere pixel

I migliori modelli odierni cancellano le imperfezioni tra pixel e pori. NVIDIA StyleGAN3 (2021) ed EdEdit (2023) sintetizzano volti 1024×1024 che, nei test psicofisici, ingannano il 45–55 % degli spettatori: appena sopra la casualità ma sotto la soglia del 50 % che gli psicologi considerano “inganno a livello umano”. I modelli di diffusione come DALL·E 3 e Stable Diffusion XL spingono ulteriormente il realismo permettendo agli utenti di inserire attributi come “cicatrici da acne lievi, illuminazione alla Rembrandt, inclinazione della testa a 45 gradi”. I benchmark rilasciati mostrano che gli valutatori umani classificano erroneamente i ritratti generati dall’IA come reali nel 61 % dei casi quando le immagini vengono mostrate per soli 150 millisecondi, meno di uno sguardo.

Dove i sistemi ancora inciampano è l’anatomia delle articolazioni: le dita spesso si fondono in salsicce, le orecchie si staccano come caratteri Wingdings e i denti diventano una griglia monocromatica. I video sono ancora più difficili; Sora (febbraio 2024) può generare clip di 60 secondi di “persone” che camminano, ma il tasso di ammiccamento è sbagliato, i pori della pelle lampeggiano come luci stroboscopiche e la mano sinistra di solito copia la destra.

Tappe fondamentali: la corsa nella valle perturbante

- Dicembre 2017 — ProGAN (NVIDIA) scala le GAN a volti 1024×1024. I primi spettatori riportano vibrazioni da “bambola inquietante”.

- Ottobre 2018 — StyleGAN debutta. I volti ora hanno pori, rughe e illuminazione asimmetrica. Gli utenti di Reddit soprannominano i risultati “avatar magici”.

- Aprile 2019 — I volti di StyleGAN raggiungono il tasso di inganno del 50,0 % in uno studio controllato dell’Università di Washington. I ricercatori aggiornano silenziosamente il titolo del documento di benchmark a metà revisione: “L’efficacia irragionevole dei volti deepfake”.

- Febbraio 2021 — StyleGAN3 introduce l’equivarianza, permettendo ai volti di ruotare senza il bagliore “plastico” dei modelli precedenti. Le celebrità iniziano a notare i loro sosia che si licenziano per pubblicità.

- Marzo 2023 — Adobe Firefly lancia uno strumento di riempimento generativo che può inserire un collega dall’aspetto plausibile in un ritratto aziendale, completo di trama della camicia corrispondente.

- Febbraio 2024 — ElevenLabs rilascia un’API di clonazione vocale; un mese dopo, un TikTok virale mostra un “CEO” sintetico che annuncia licenziamenti con la voce e il volto del fondatore, clonati da un singolo clip della chiamata sugli utili.

L’aspetto umano: chi vince, chi si disperde

Per i direttori del casting, i fotogiornalisti e le agenzie di modelle, questa nuova capacità è contemporaneamente una corsa all’oro e una crisi di identità. I reclutatori ora intervistano i candidati tramite sostituti generati dall’IA per i primi screening; una piattaforma HR riporta un calo del 30 % dei no-show perché gli avatar sintetici non annullano mai all’ultimo minuto. Eppure lo stesso strumento permette ai regimi autoritari di produrre “prove” di dissidenti fabbricati che partecipano a proteste, seminando dubbi più velocemente di quanto i fact-checker possano smascherarli.

"Ogni miglioramento dello 0,1 % nel tasso di inganno non muove solo i pixel: ridistribuisce il rischio dalle piattaforme ai pubblici."

Gli artisti che un tempo vendevano ritratti stock vedono evaporare da un giorno all’altro i loro flussi di royalties. Nel frattempo, le startup di volti sintetici raccolgono round seed sulla premessa che ogni vita umana possa essere clonata in un ambasciatore di marca. I perdenti sono le infrastrutture di fiducia: le scuole di giornalismo aggiungono laboratori di rilevamento deepfake, le agenzie di frontiera dispiegano test di vivacità e le famiglie imparano a fare un gesto con la mano durante le chiamate Zoom natalizie.

Cosa ci aspetta: i prossimi 12–24 mesi

Ci si aspetta che due filoni accelerino in parallelo. Innanzitutto, le corse agli armamenti di fedeltà: Stable Diffusion 3 (previsto per il terzo trimestre 2024) promette volti in 4K con ciocche di capelli stabili e incisivi che sembrano davvero denti. In secondo luogo, le tecnologie di watermarking e standard di provenienza si induriranno; Adobe CAI (Content Authenticity Initiative) già incorpora hash crittografici nei metadati EXIF dei ritratti generati e il Regolamento UE sull’IA (in vigore a metà 2025) richiederà la divulgazione per umani sintetici “realistici”.

Nei video, Runway Gen-3 e Pika Labs stanno iterando su clip “testa parlante” in 1080p che possono sincronizzare le labbra con qualsiasi sceneggiatura in meno di cinque minuti. Il divario tra “perturbante” e “banale” si sta riducendo, ma l’ostacolo finale rimane la coerenza: una clip di 30 secondi si tradisce ancora in due o tre ammiccamenti.

Gli eticisti prevedono un’impennata di servizi di “protezione del volto”: app che permettono agli utenti di caricare un selfie e generare un intero kit di media sintetici per comunicazioni sicure. Nel frattempo, i truffatori romantici usano già questi modelli per clonare i volti di celebrità e soldati, contando sul riflesso umano di fidarsi di un bel sorriso.

Riflessione: lo specchio che abbiamo rotto

Un tempo ci preoccupavamo che Photoshop cancellasse una ruga. Ora Photoshop può cancellare un’intera identità. La tappa fondamentale non è stata febbraio 2019, quando il modello ha ingannato metà di noi, ma il momento in cui abbiamo smesso di preoccuparci a quale metà appartenessimo. La vera domanda non è se l’IA possa creare umani falsi fotorealistici, ma quanti di noi si preoccuperanno ancora di guardare.