Le visage dans la foule qui n'est pas humain

Un mardi de mars 2024, un post bleu azur sur LinkedIn est arrivé dans mon fil d’actualité avec une photo d’une femme dont le regard perçant semblait juger mon choix de café du matin. Elle avait la lueur subtile de la lumière naturelle d’une fenêtre, une légère tache de rousseur sous son sourcil droit, et un sourire malicieux de fine mouche – pas la photo corporate polie habituelle. Une recherche d’image inversée n’a rien donné. Son nom était « Elena K. » et, selon sa biographie, elle dirigeait l’éthique de l’IA dans une startup berlinoise secrète. Lorsque j’ai envoyé un message à l’entreprise, la réceptionniste a répondu : « Nous n’avons personne portant ce nom. »

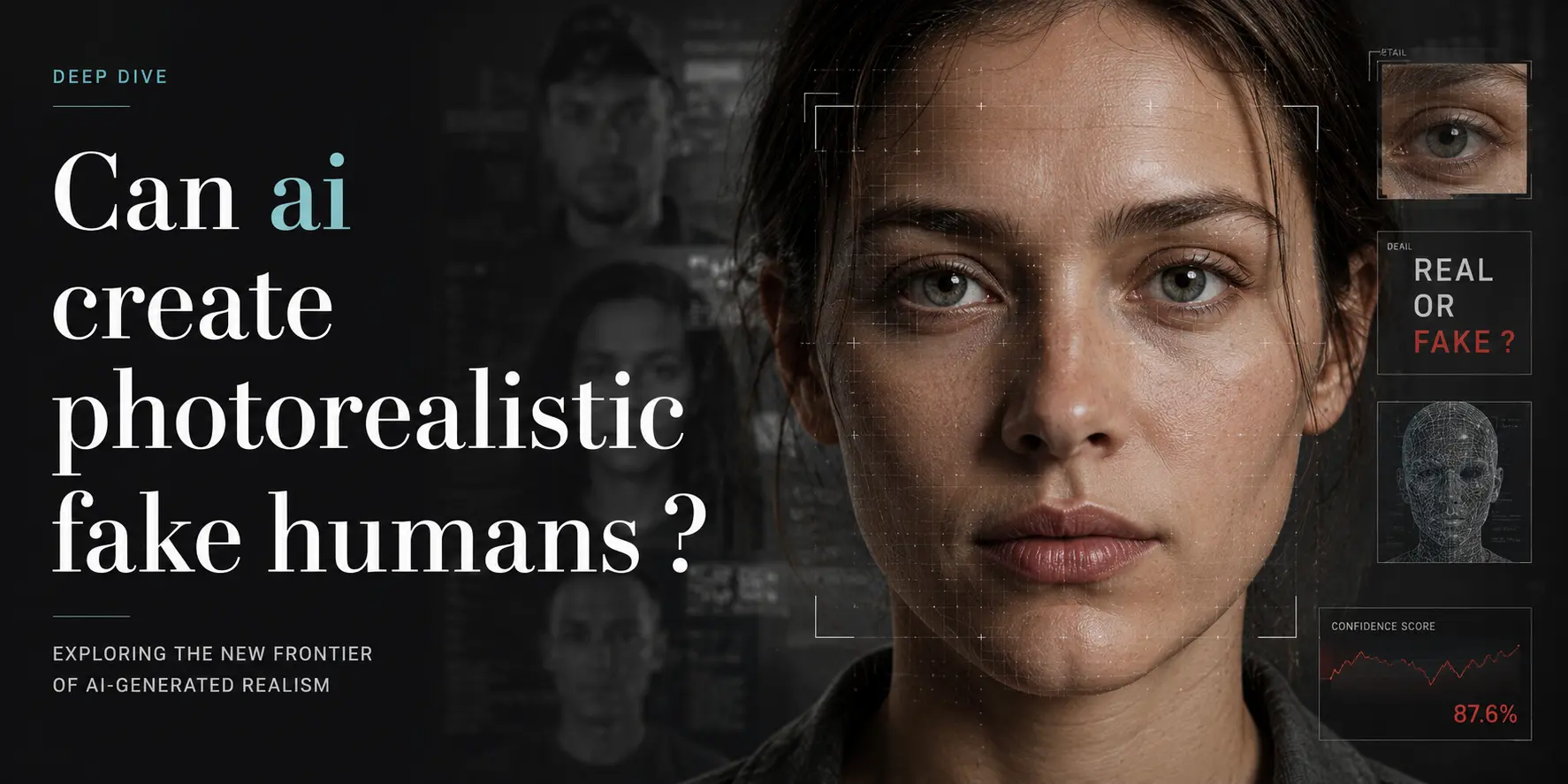

« La première fois qu’un modèle a trompé plus de la moitié des juges humains, c’était en avril 2019 – les visages de StyleGAN ont franchi le seuil sans que personne ne s’en aperçoive. »

État de l’art : des pixels qui oublient qu’ils sont des pixels

Les meilleurs modèles actuels effacent les coutures entre les pixels et les pores. StyleGAN3 (2021) et EdEdit (2023) de NVIDIA synthétisent des visages de 1024×1024 pixels qui, lors de tests psychophysiques, trompent 45 à 55 % des spectateurs – juste au-dessus du hasard, mais en dessous du seuil de 50 % que les psychologues considèrent comme une tromperie « au niveau humain ». Les modèles de diffusion comme DALL·E 3 et Stable Diffusion XL poussent le réalisme plus loin en permettant aux utilisateurs de spécifier des attributs comme « cicatrices d’acné subtiles, éclairage à la Rembrandt, inclinaison de la tête à 45 degrés ». Les benchmarks publiés montrent que les évaluateurs humains classent à tort des portraits générés par IA comme réels 61 % du temps lorsque les images ne sont affichées que pendant 150 millisecondes – moins qu’un regard.

Là où les systèmes échouent encore, c’est sur l’anatomie des articulations : les doigts se fondent souvent en saucisses, les oreilles se détachent comme des wingdings, et les dents deviennent une grille monochrome. La vidéo est encore plus difficile ; Sora (février 2024) peut générer des clips de 60 secondes de « personnes » marchant, mais le taux de clignement est incorrect, les pores de la peau clignotent comme des stroboscopes, et la main gauche copie généralement la droite.

Jalons clés : la course à la vallée de l’étrange

- Décembre 2017 — ProGAN (NVIDIA) fait évoluer les GAN vers des visages de 1024×1024 pixels. Les premiers spectateurs rapportent des vibes de « poupée creepy ».

- Octobre 2018 — StyleGAN fait ses débuts. Les visages ont maintenant des pores, des rides et un éclairage asymétrique. Les utilisateurs de Reddit surnomment les résultats « avatars magiques ».

- Avril 2019 — Les visages de StyleGAN atteignent un taux de tromperie de 50,0 % dans une étude contrôlée de l’Université de Washington. Les chercheurs mettent discrètement à jour le titre de l’article de référence en cours de révision : « L’efficacité déraisonnable des visages deepfake ».

- Février 2021 — StyleGAN3 introduit l’équivariance, permettant aux visages de tourner sans l’aspect « plastique » des modèles précédents. Les célébrités commencent à remarquer leurs sosies se faire licencier pour des publicités.

- Mars 2023 — Adobe Firefly lance un outil de remplissage génératif capable d’insérer un collègue plausible dans une photo corporate – avec une texture de chemise assortie.

- Février 2024 — ElevenLabs publie une API de clonage vocal ; un mois plus tard, un TikTok viral montre un « PDG » synthétique annonçant des licenciements avec la voix et le visage du fondateur, clonés à partir d’un seul clip d’appel d’earnings.

L’aspect humain : qui gagne, qui se disperse

Pour les directeurs de casting, les photoreporters et les agences de mannequins, cette nouvelle capacité est à la fois une ruée vers l’or et une crise identitaire. Les recruteurs interviewent désormais des candidats via des avatars générés par IA pour les premiers entretiens ; une plateforme RH rapporte une baisse de 30 % des absences de dernière minute parce que les avatars synthétiques ne annulent jamais au dernier moment. Pourtant, le même outil permet à des régimes autoritaires de produire des « preuves » de dissidents fabriqués assistant à des manifestations, semant le doute plus vite que les fact-checkers ne peuvent le démêler.

« Chaque amélioration de 0,1 % du taux de tromperie ne déplace pas seulement des pixels – elle redistribue les risques des plateformes vers le public. »

Les artistes qui vendaient autrefois des portraits de stock voient leurs revenus royalties s’évaporer du jour au lendemain. Pendant ce temps, les startups de visages synthétiques lèvent des fonds d’amorçage sur la prémisse que chaque vie humaine peut être clonée en un ambassadeur de marque. Les perdants sont les infrastructures de confiance : les écoles de journalisme ajoutent des laboratoires de détection de deepfakes, les agences frontalières déploient des tests de vivacité, et les familles apprennent à agiter la main lors des appels Zoom des fêtes.

Ce qui nous attend : les 12 à 24 prochains mois

On peut s’attendre à ce que deux tendances s’accélèrent en parallèle. D’abord, la course à la fidélité : Stable Diffusion 3 (prévu pour le T3 2024) promet des visages en résolution 4K avec des mèches de cheveux stables et des incisives qui ressemblent vraiment à des dents. Ensuite, les normes de filigrane et de traçabilité vont se renforcer ; l’initiative CAI (Content Authenticity Initiative) d’Adobe intègre déjà des hachages cryptographiques dans les métadonnées EXIF des portraits générés, et le règlement IA de l’UE (appliqué mi-2025) exigera une divulgation pour les humains synthétiques « réalistes ».

Pour la vidéo, Runway Gen-3 et Pika Labs itèrent sur des clips « talking head » en 1080p qui peuvent se synchroniser sur n’importe quel script en moins de cinq minutes. L’écart entre « étrange » et « ordinaire » se réduit, mais le défi ultime reste la cohérence : un clip de 30 secondes se trahit encore en deux ou trois clignements.

Les éthiciens prévoient une vague de services de « protection par duplication de visage » – des applications qui permettent aux utilisateurs de télécharger une selfie et de générer une trousse de médias synthétiques complète pour des communications sécurisées. Pendant ce temps, les arnaqueurs en ligne utilisent déjà ces modèles pour cloner les visages de célébrités et de soldats, comptant sur le réflexe humain de faire confiance à un beau sourire.

Réflexion : le miroir que nous avons brisé

Nous nous inquiétions autrefois de Photoshop pour effacer une ride. Maintenant, Photoshop peut effacer une identité entière. Le jalon n’a pas été février 2019, lorsque le modèle a trompé la moitié d’entre nous – c’est le moment où nous avons cessé de nous soucier de savoir à quelle moitié nous appartenions. La vraie question n’est pas de savoir si l’IA peut créer des humains synthétiques photoréalistes, mais combien d’entre nous prendront encore la peine de regarder.