El rostro en la multitud que no es humano

Un martes de marzo de 2024, una publicación de LinkedIn en color azul cielo llegó a mi feed con una foto de perfil de una mujer cuyo agudo mirada parecía juzgar mi elección de café matutino. Tenía el brillo sutil de la luz natural de una ventana, una pecosa tenue debajo de su ceja derecha y una sonrisa socarrona de bromista —no la típica foto corporativa pulida. Una búsqueda inversa de imágenes no arrojó resultados. Su nombre era “Elena K.” y, según su biografía, lideraba la ética de IA en una startup emergente de Berlín. Cuando le envié un mensaje a la empresa, la recepcionista respondió: “No tenemos a nadie con ese nombre”.

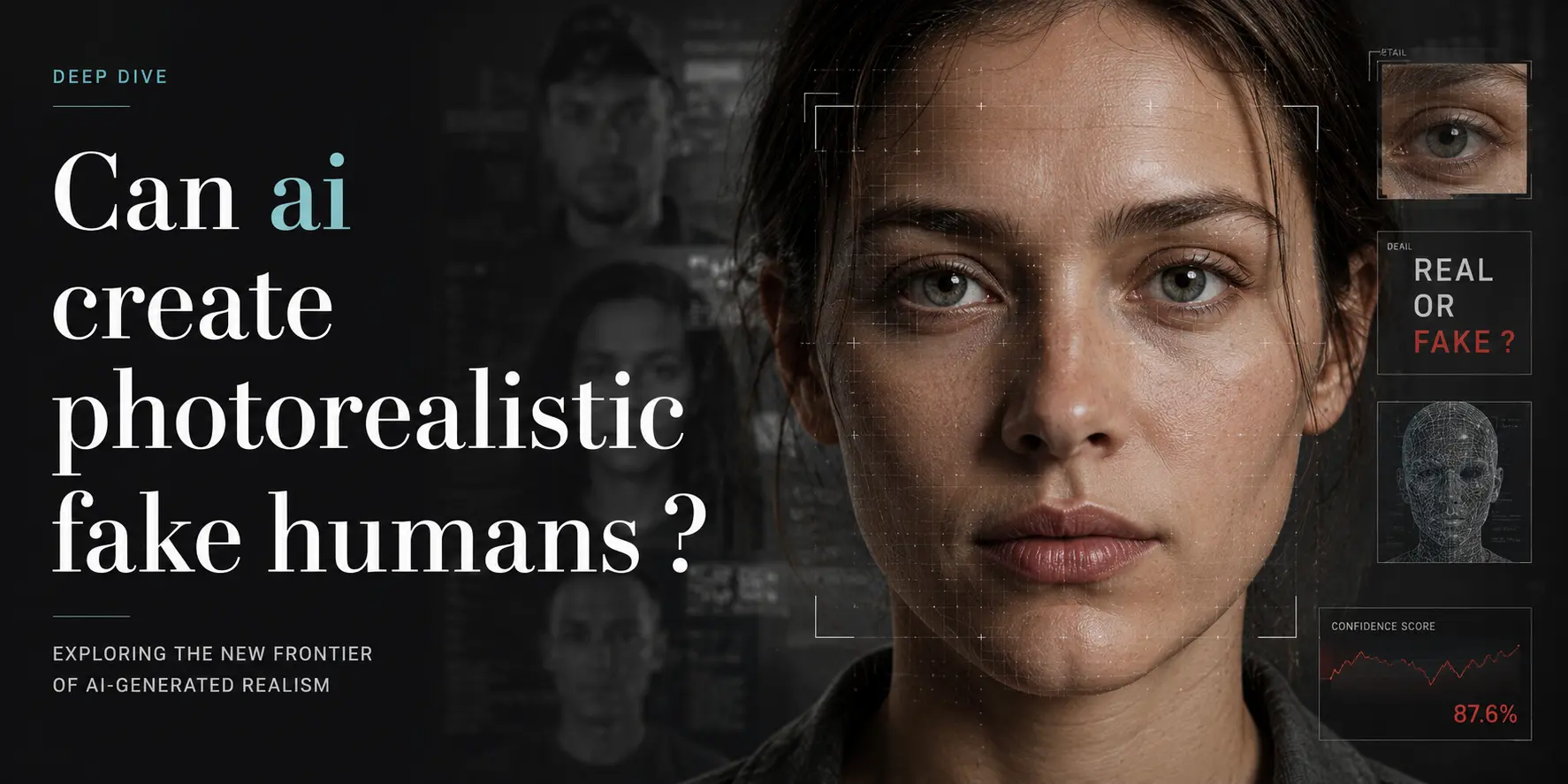

"La primera vez que un modelo engañó a más de la mitad de jueces humanos fue en abril de 2019: los rostros de StyleGAN cruzaron el umbral sin que nadie lo notara."

Estado del arte: píxeles que olvidan que son píxeles

Los mejores modelos actuales borran las costuras entre píxeles y poros. StyleGAN3 de NVIDIA (2021) y EdEdit (2023) sintetizan rostros de 1024×1024 que, en pruebas psicofísicas, engañan al 45–55 % de los espectadores —justo por encima del azar pero por debajo del umbral del 50 % que los psicólogos consideran “decepción a nivel humano”. Los modelos de difusión como DALL·E 3 y Stable Diffusion XL llevan el realismo más allá al permitir a los usuarios solicitar atributos como “cicatrices sutiles de acné, iluminación de Rembrandt, inclinación de cabeza de 45 grados”. Los puntos de referencia publicados muestran que evaluadores humanos clasifican erróneamente los retratos generados por IA como reales el 61 % de las veces cuando las imágenes se muestran durante solo 150 milisegundos —menos que un vistazo.

Donde los sistemas aún tropiezan es en la anatomía de las articulaciones: los dedos suelen fusionarse en salchichas, las orejas se desprenden como símbolos de ala, y los dientes se convierten en una rejilla monocromática. El video es aún más difícil; Sora (febrero de 2024) puede generar clips de 60 segundos de “personas” caminando, pero la frecuencia de parpadeo es incorrecta, los poros de la piel parpadean como luces estroboscópicas y la mano izquierda suele copiar a la derecha.

Hitos clave: la carrera del valle inquietante

- Diciembre de 2017 — ProGAN (NVIDIA) escala GANs a rostros de 1024×1024. Los primeros espectadores reportan vibes de “muñeca escalofriante”.

- Octubre de 2018 — Debuta StyleGAN. Los rostros ahora tienen poros, arrugas e iluminación asimétrica. Los usuarios de Reddit apodan los resultados “avatares mágicos”.

- Abril de 2019 — Los rostros de StyleGAN alcanzan la tasa de engaño del 50.0 % en un estudio controlado por la Universidad de Washington. Los investigadores actualizan en silencio el título del artículo de referencia a mitad de la revisión: “La eficacia irrazonable de los rostros deepfake”.

- Febrero de 2021 — StyleGAN3 introduce la equivariancia, permitiendo que los rostros roten sin el brillo “plástico” de modelos anteriores. Las celebridades comienzan a notar que sus dobles se licencian para anuncios.

- Marzo de 2023 — Adobe Firefly lanza una herramienta de relleno generativo que puede insertar un compañero de trabajo plausible en una foto corporativa —completo con la textura de la camisa coincidente.

- Febrero de 2024 — ElevenLabs lanza una API de clonación de voz; un mes después, un TikTok viral muestra un “CEO” sintético anunciando despidos con la voz y rostro del fundador, clonados a partir de un solo clip de la llamada de ganancias.

El ángulo humano: quién gana, quién se dispersa

Para directores de casting, fotoperiodistas y agencias de modelos, esta nueva capacidad es simultáneamente una fiebre del oro y una crisis de identidad. Los reclutadores ahora entrevistan candidatos mediante sustitutos generados por IA para las primeras evaluaciones; una plataforma de RRHH reporta una caída del 30 % en inasistencias porque los avatares sintéticos nunca cancelan a último momento. Sin embargo, la misma herramienta permite a regímenes autoritarios producir “pruebas” de disidentes fabricados asistiendo a protestas, sembrando dudas más rápido de lo que los verificadores de hechos pueden desmentir.

"Cada mejora del 0.1 % en la tasa de engaño no solo mueve píxeles —redistribuye el riesgo de las plataformas al público."

Los artistas que antes vendían retratos de stock ven desaparecer sus regalías de la noche a la mañana. Mientras tanto, las startups de rostros sintéticos recaudan rondas semilla bajo la premisa de que cada vida humana puede clonarse en un embajador de marca. Los perdedores son las infraestructuras de confianza: las escuelas de periodismo añaden laboratorios de detección de deepfakes, las agencias de fronteras despliegan pruebas de vitalidad, y las familias aprenden a hacer un gesto con la mano frente a las videollamadas de Zoom en las fiestas.

Qué sigue: los próximos 12–24 meses

Se espera que dos líneas se aceleren en paralelo. En primer lugar, las carreras de fidelidad: Stable Diffusion 3 (programado para Q3 de 2024) promete rostros en resolución 4K con mechones de cabello estables e incisivos que realmente parezcan dientes. En segundo lugar, los estándares de marca de agua y procedencia se endurecerán; la Iniciativa de Autenticidad de Contenido (CAI) de Adobe ya incrusta hashes criptográficos en los metadatos EXIF de los retratos generados, y el Reglamento de IA de la UE (aplicado a mediados de 2025) exigirá divulgación para humanos sintéticos “realistas”.

En video, Runway Gen-3 y Pika Labs están iterando en clips de “cabezas parlantes” en 1080p que pueden sincronizar labios con cualquier guion en menos de cinco minutos. La brecha entre “inquietante” y “insignificante” se está reduciendo, pero el obstáculo definitivo sigue siendo la consistencia: un clip de 30 segundos aún se delata en dos o tres parpadeos.

Los éticos predicen un aumento en los servicios de “protección de rostros duplicados” —aplicaciones que permiten a los usuarios subir una selfie y generar un kit completo de medios sintéticos para comunicaciones seguras. Mientras tanto, los estafadores románticos ya usan estos modelos para clonar los rostros de celebridades y soldados, aprovechando el reflejo humano de confiar en una sonrisa bonita.

Reflexión: el espejo que rompimos

Antes nos preocupaba que Photoshop eliminara una arruga. Ahora Photoshop puede eliminar toda una identidad. El hito no fue febrero de 2019, cuando el modelo engañó a la mitad de nosotros, sino el momento en que dejamos de importarnos a cuál mitad pertenecíamos. La verdadera pregunta no es si la IA puede crear humanos falsos fotorrealistas, sino cuántos de nosotros seguiremos molestándonos en mirar.