Das Gesicht in der Menge, das nicht menschlich ist

An einem Dienstag im März 2024 landete ein himmelblauer LinkedIn-Post in meinem Feed mit einem Porträtfoto einer Frau, deren scharfer Blick meine Wahl des Morgenkaffees zu beurteilen schien. Sie hatte das dezente Leuchten von natürlichem Tageslicht, einen leichten Sommerspross unter der rechten Augenbraue und ein schlagfertiges Grinsen – nicht das übliche polierte Stockfoto aus der Unternehmenswelt. Eine Rückwärtssuche lieferte keine Ergebnisse. Ihr Name war „Elena K.“ und laut ihrem Profil leitete sie bei einem geheimen Berliner Startup die KI-Ethik. Als ich die Firma kontaktierte, antwortete die Rezeptionistin: „Wir haben niemanden mit diesem Namen.“

"Das erste Mal, dass ein Modell mehr als die Hälfte der menschlichen Juroren täuschte, war im April 2019 – die Gesichter von StyleGAN überschritten die Schwelle, ohne dass es jemand bemerkte."

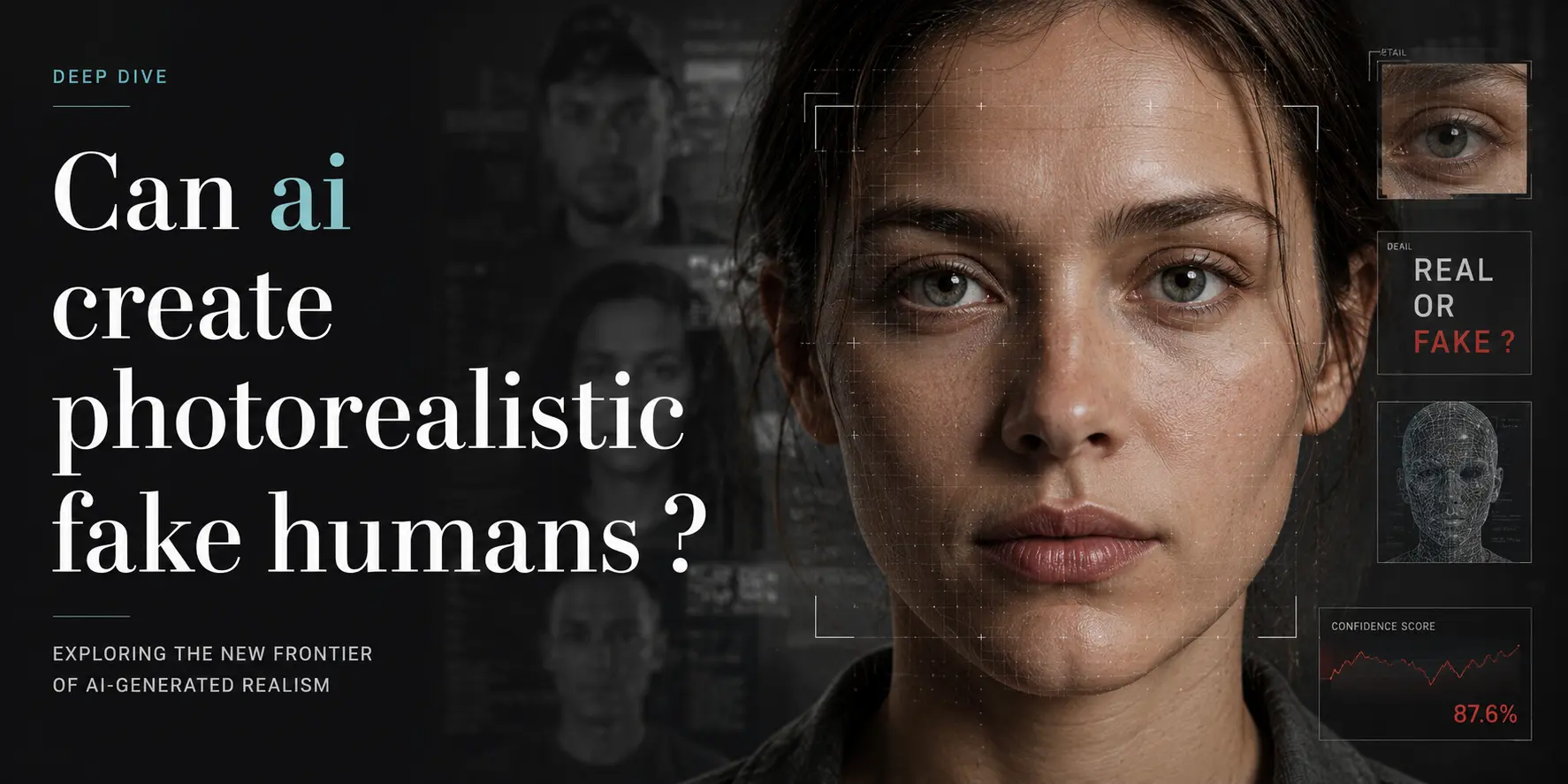

Stand der Technik: Pixel, die vergessen, dass sie Pixel sind

Die besten heutigen Modelle verwischen die Nahtstellen zwischen Pixeln und Poren. NVIDIAs StyleGAN3 (2021) und EdEdit (2023) synthetisieren 1024×1024-Gesichter, die in psychophysikalischen Tests 45–55 % der Betrachter täuschen – knapp über dem Zufallsniveau, aber unter der 50 %-Schwelle, die Psychologen als „menschliches Täuschungsniveau“ betrachten. Diffusionsmodelle wie DALL·E 3 und Stable Diffusion XL treiben den Realismus weiter voran, indem Nutzer Attribute wie „dezent Akne, Rembrandt-Beleuchtung, 45-Grad-Kopfneigung“ eingeben können. Veröffentlichte Benchmarks zeigen, dass menschliche Evaluatoren KI-generierte Porträts in 61 % der Fälle für echt halten, wenn die Bilder nur für 150 Millisekunden – kürzer als ein Blick – gezeigt werden.

Wo die Systeme noch stolpern, ist die Anatomie an den Gelenken: Finger verschmelzen oft zu Würstchen, Ohren lösen sich wie Wingdings ab, und Zähne werden zu einem monochromen Gitter. Videos sind noch schwieriger; Sora (Februar 2024) kann 60-Sekunden-Clips von „Menschen“ erzeugen, die gehen, aber die Blinzelrate stimmt nicht, Hautporen flackern wie Stroboskoplichter, und die linke Hand kopiert meist die rechte.

Wichtige Meilensteine: der Sprint durch das Uncanny Valley

- Dezember 2017 – ProGAN (NVIDIA) skaliert GANs auf 1024×1024-Gesichter. Frühe Betrachter berichten von „gruseligen Puppen“-Vibes.

- Oktober 2018 – StyleGAN debütiert. Gesichter haben nun Poren, Falten und asymmetrische Beleuchtung. Reddit-Nutzer nennen die Ergebnisse „magische Avatare“.

- April 2019 – Die Gesichter von StyleGAN erreichen in einer kontrollierten Studie der University of Washington eine Täuschungsrate von 50,0 %. Die Forscher aktualisieren den Titel des Benchmark-Papiers während der Überprüfung leise: „The Unreasonable Effectiveness of Deepfake Faces“.

- Februar 2021 – StyleGAN3 führt Äquivarianz ein und lässt Gesichter rotieren, ohne den „plastischen“ Schimmer früherer Modelle. Prominente beginnen, ihre Doppelgänger zu bemerken, die sich für Werbung lizenzieren lassen.

- März 2023 – Adobe Firefly bringt ein generatives Füllwerkzeug auf den Markt, das einen plausibel aussehenden Kollegen in ein Firmenporträt einfügen kann – inklusive passender Hemdtextur.

- Februar 2024 – ElevenLabs veröffentlicht eine Sprachklon-API; einen Monat später zeigt ein viraler TikTok einen synthetischen „CEO“, der Entlassungen in der Stimme und im Gesicht des Gründers bekannt gibt – geklont aus einem einzigen Gewinnaufruf-Ausschnitt.

Der menschliche Aspekt: Wer gewinnt, wer verschwindet

Für Casting-Direktoren, Fotojournalisten und Modelagenturen ist diese neue Fähigkeit gleichzeitig ein Goldrausch und eine Identitätskrise. Personalvermittler führen nun Vorstellungsgespräche mit KI-generierten Stellvertretern für erste Screenings durch; eine HR-Plattform berichtet von einem Rückgang der No-Shows um 30 %, weil synthetische Avatare nie kurzfristig absagen. Doch dasselbe Werkzeug ermöglicht autoritären Regimen, „Beweise“ für erfundene Dissidenten zu produzieren, die an Protesten teilnehmen – und säen Zweifel schneller, als Faktenchecker sie widerlegen können.

"Jede 0,1 %-Verbesserung der Täuschungsrate bewegt nicht nur Pixel – sie verteilt Risiken von Plattformen auf die Öffentlichkeit um."

Künstler, die einst Stock-Porträts verkauften, sehen über Nacht ihre Royaltyströmungen versiegen. Gleichzeitig sammeln Startups für synthetische Gesichter Seed-Runden unter der Prämisse, dass jedes Menschenleben in einen Markenbotschafter geklont werden kann. Die Verlierer sind die Vertrauensinfrastrukturen: Journalistenschulen richten Deepfake-Erkennungslabore ein, Grenzbehörden setzen Lebendigkeitstests ein, und Familien lernen, bei Weihnachtsvideoanrufen mit der Hand zu winken.

Was kommt: die nächsten 12–24 Monate

Es ist zu erwarten, dass sich zwei Entwicklungen parallel beschleunigen. Erstens der Wettlauf um die Detailtreue: Stable Diffusion 3 (geplant für Q3 2024) verspricht 4K-Gesichter mit stabilen Haarsträhnen und Zähnen, die tatsächlich wie Zähne aussehen. Zweitens werden Wasserzeichen und Herkunftsstandards strenger; Adobes CAI (Content Authenticity Initiative) baut bereits kryptografische Hashes in die EXIF-Daten generierter Porträts ein, und der EU AI Act (in Kraft Mitte 2025) wird Offenlegung für „realistische“ synthetische Menschen vorschreiben.

Bei Videos arbeiten Runway Gen-3 und Pika Labs an 1080p-„Talking-Head“-Clips, die jeden Text in unter fünf Minuten lipsynchronisieren können. Die Lücke zwischen „unheimlich“ und „unauffällig“ schrumpft, doch die größte Hürde bleibt die Konsistenz: Ein 30-Sekunden-Clip verrät sich innerhalb von zwei oder drei Lidschlägen.

Ethiker sagen einen Anstieg von „Gesichtsverdoppelungs“-Schutzservices voraus – Apps, die es Nutzern ermöglichen, ein Selfie hochzuladen und einen vollständigen synthetischen Medienkit für sichere Kommunikation zu generieren. Gleichzeitig nutzen Romance-Scammer diese Modelle bereits, um die Gesichter von Prominenten und Soldaten zu klonen und sich auf den menschlichen Reflex zu verlassen, einem hübschen Lächeln zu vertrauen.