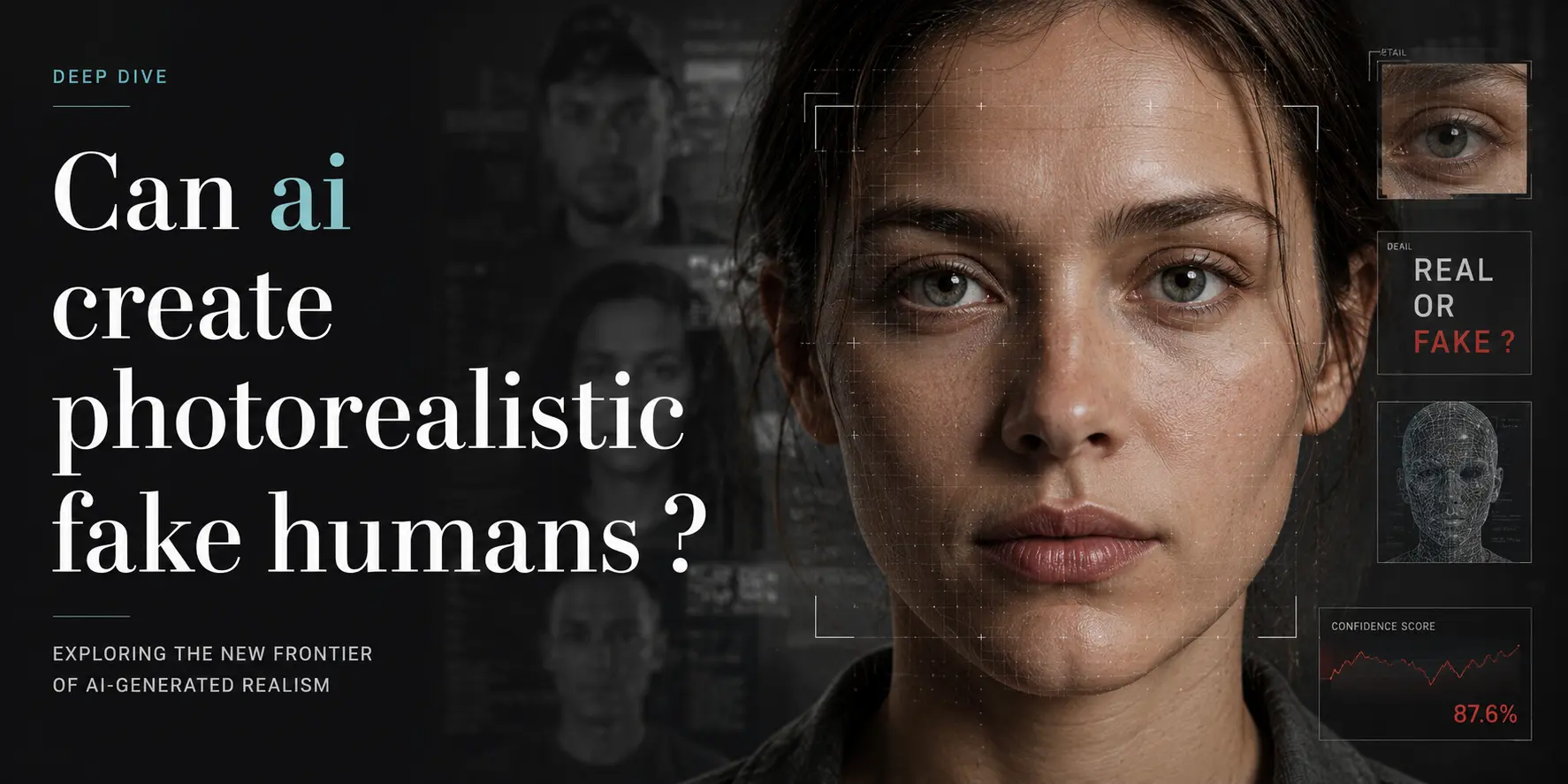

Ansigtet i mængden, der ikke er menneskeligt

En tirsdag i marts 2024 landede et lyseblåt LinkedIn-indlæg i min feed med et portrætfoto af en kvinde, hvis skarpe blik syntes at dømme mit valg af morgenkaffe. Hun havde det subtile skær af naturligt vindueslys, en svag fregne under højre øjenbryn og en vittig smilende mund – ikke det sædvanlige polerede corporate stockfoto. Et omvendt billedesøgning returnerede intet. Hendes navn var “Elena K.” og ifølge biografien ledede hun AI-etik i en hemmelig Berlin-startup. Da jeg sendte en besked til virksomheden, svarede receptionisten: “Vi har ingen med det navn.”

"Første gang en model narrede mere end halvdelen af menneskelige dommere var april 2019 – StyleGAN’s ansigter krydsede tærsklen uden at nogen lagde mærke til det."

Nuværende stand: pixels, der glemmer, at de er pixels

Dagens bedste modeller fjerner sømmene mellem pixels og porer. NVIDIA’s StyleGAN3 (2021) og EdEdit (2023) syntetiserer 1024×1024 ansigter, der i psykofysiske tests narre 45–55 % af seerne – lige over tilfældighed, men under den 50 %-tærskel, som psykologer anser for “menneskelig niveau” bedrag. Diffusionsmodeller som DALL·E 3 og Stable Diffusion XL skubber realismen længere ved at lade brugere skrive attributter som “subtile akne-ar, Rembrandt-belysning, 45-graders hovedvipning”. Udgivne benchmarks viser, at menneskelige evaluatorer fejlklassificerer AI-genererede portrætter som ægte 61 % af tiden, når billederne vises i kun 150 millisekunder – kortere end et blik.

Hvor systemerne stadig vakler, er det anatomien ved leddene: fingre smelter ofte sammen til pølser, ører løsner sig som wingdings, og tænder bliver til en ensfarvet gitter. Video er endnu sværere; Sora (feb. 2024) kan generere 60-sekunders klip af “mennesker”, der går, men blinkfrekvensen er forkert, hudporerne flimrer som stroboskoplys, og venstre hånd kopierer normalt højre.

Nøgle milepæle: kapløbet i den uhyggelige dal

- December 2017 — ProGAN (NVIDIA) skalerer GAN’er til 1024×1024 ansigter. Tidlige seere rapporterer om “uhyggelige dukke” vibes.

- Oktober 2018 — StyleGAN debuterer. Ansigter har nu porer, rynker og asymmetrisk belysning. Reddit-brugere kalder outputtene for “magiske avatarer”.

- April 2019 — StyleGAN’s ansigter når 50,0 % narreprocent i en kontrolleret undersøgelse fra University of Washington. Forskere opdaterer diskret titlen på benchmark-papiret midt i gennemgangen: “The Unreasonable Effectiveness of Deepfake Faces”.

- Februar 2021 — StyleGAN3 introducerer ækvivalens, så ansigter kan rotere uden det “plastikagtige” skær fra tidligere modeller. Berømtheder begynder at bemærke, at deres dobbeltgængere licenserer sig selv til reklamer.

- Marts 2023 — Adobe Firefly lancerer et generativt udfyldningsværktøj, der kan indsætte en plausibel kollega i et corporate portræt – komplet med matchende skjortekulør.

- Februar 2024 — ElevenLabs frigiver en stemmeklonings-API; en måned senere viser en viral TikTok en syntetisk “CEO”, der annoncerer fyringer i grundlæggerens stemme og ansigt, klonet fra et enkelt regnskabsklip.

Det menneskelige aspekt: hvem vinder, hvem flygter

For castingdirektører, fotojournalister og modelbureauer er den nye evne samtidig en guldfeber og en identitetskrise. Rekrutteringsfolk interviewer nu kandidater via AI-genererede stand-ins til indledende screeninger; én HR-platform rapporterer om et fald på 30 % i udeblivelser, fordi syntetiske avatarer aldrig aflyser i sidste øjeblik. Alligevel lader det samme værktøj autoritære regimer producere “beviser” på fabrikerede dissidenter, der deltager i demonstrationer, og spreder tvivl hurtigere, end factcheckere kan afkræfte.

"Hver 0,1 % forbedring i narreprocent flytter ikke blot pixels – det omfordeler risiko fra platforme til offentligheden."

Kunstnere, der tidligere solgte stockportrætter, ser pludselig deres royaltyindtægter forsvinde natten over. I mellemtiden rejser syntetiske ansigts-startups kapital på præmissen om, at hvert menneskeliv kan klones til en brandambassadør. De tabende parter er tillidens infrastruktur: journalistskoler tilføjer laboratorier for deepfake-detektion, grænseagenturer indfører livstests, og familier lærer at vifte med hånden foran julezoomopkald.

Hvad kommer der: de næste 12–24 måneder

Forvent to spor, der accelererer parallelt. Først, præcisionskapløbet: Stable Diffusion 3 (planlagt Q3 2024) lover 4K-opløsningsansigter med stabile hårstrå og tænder, der faktisk ligner tænder. Dernæst vil vandmærkning og oprindelsesstandarder hærde; Adobe’s CAI (Content Authenticity Initiative) indlejrer allerede kryptografiske hasher i genererede portræt-EXIF, og EU’s AI-forordning (håndhæves midt-2025) vil kræve oplysning for “realistiske” syntetiske mennesker.

Inden for video itererer Runway Gen-3 og Pika Labs på 1080p “talende hoved”-klip, der kan synkronisere læber til ethvert manuskript på under fem minutter. Afstanden mellem “uhyggelig” og “ubemærket” bliver mindre, men den ultimative udfordring forbliver konsistens: et 30-sekunders klip afslører sig stadig inden for to eller tre blink.

Etikere forudsiger en bølge af “ansigtsdobling”-beskyttelsestjenester – apps, der lader brugere uploade et selfie og generere et helt syntetisk mediekit til sikre kommunikationer. I mellemtiden bruger dating-svindlere allerede disse modeller til at klone ansigterne på kendisser og soldater, og satser på den menneskelige refleks til at stole på et smil.

Refleksion: spejlet, vi har knust

Tidligere var vi bekymrede for Photoshop, der luftbørstede en rynke væk. Nu kan Photoshop luftbørste en hel identitet ind i eksistens. Milepælen var ikke februar 2019, da modellen narrede halvdelen af os – det var det øjeblik, hvor vi holdt op med at bekymre os om, hvilken halvdel vi tilhørte. Det egentlige spørgsmål er ikke, hvorvidt AI kan skabe fotorealistiske falske mennesker, men hvor mange af os der stadig gider at kigge.